Introduction

Illustrations

1 / 6

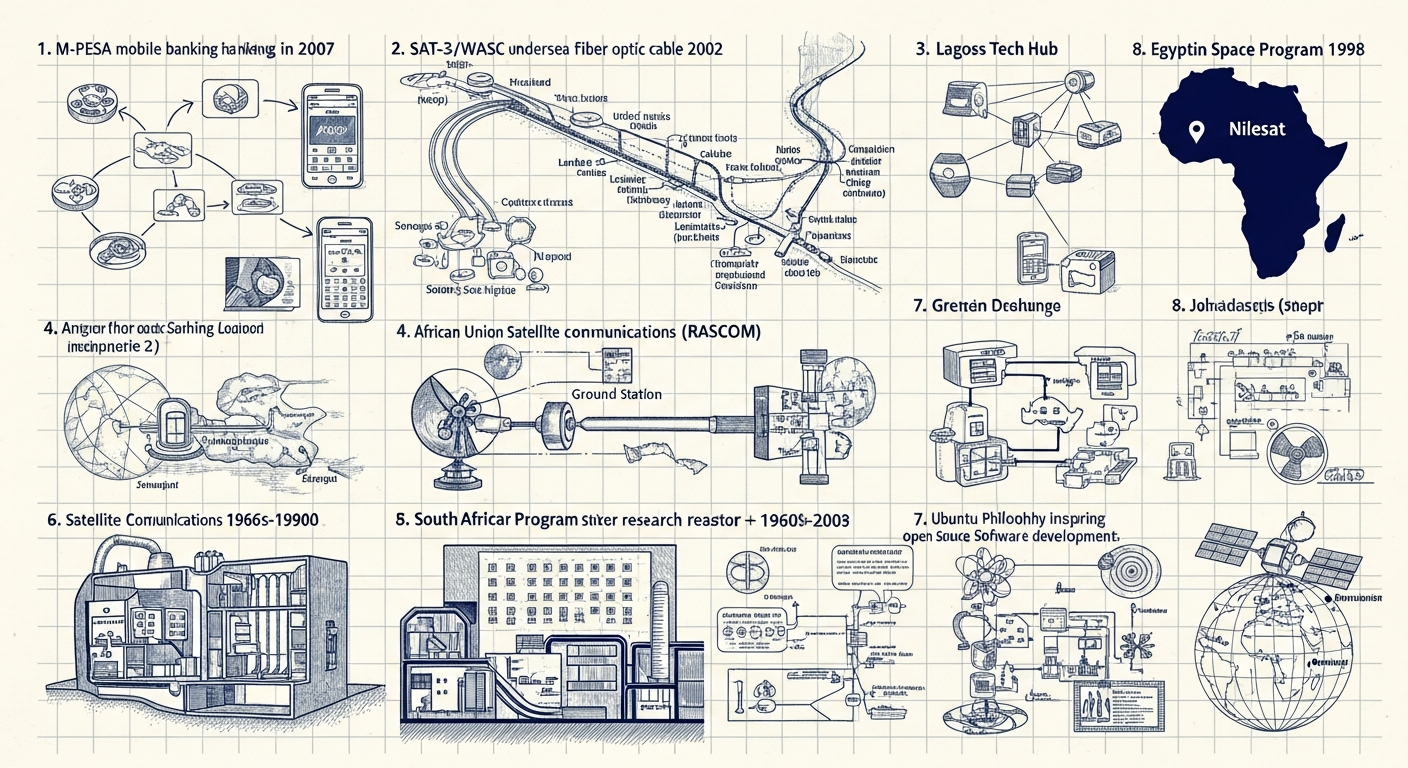

L'Afrique : de M-Pesa à Ushahidi, l'arbre à palabres devient numérique.

L'ère de l'information : Introduction

En février 1948, dans un laboratoire de Sydney, un ingénieur nommé Trevor Pearcey écrivit une phrase qui résonne encore : « Il n'est pas inconcevable qu'un service encyclopédique automatique opéré à travers le système national de téléimprimeurs ou de téléphone existera un jour. » Internet. Prédit depuis l'Australie. Quarante ans avant le World Wide Web.

Ce moment résume la période que nous traversons maintenant. Entre 1945 et 2010 — de la fin de la guerre mondiale à l'aube de la révolution de l'apprentissage profond —, l'humanité transforma les outils conceptuels forgés pendant l'ère précédente en machines réelles, en industries mondiales, en réseaux planétaires. Les circuits de Shannon et Nakashima devinrent des microprocesseurs. La machine universelle de Turing devint l'ordinateur personnel. La logique booléenne devint Internet. Le rêve de Dartmouth — simuler l'intelligence humaine — traversa des étés d'euphorie et des hivers de désillusion avant de renaître sous une forme nouvelle.

Mais cette ère fut aussi celle des bonds par-dessus l'abîme. L'Afrique, déconnectée du réseau téléphonique mondial, sauta directement au paiement mobile et inventa M-Pesa avant que l'Occident n'imagine Apple Pay. L'Inde, qui avait manqué le virage du matériel informatique, bondit vers les services logiciels et devint la sous-traitante du monde numérique. Taïwan inventa un modèle industriel — le fondeur pur — qui permit à des entreprises sans usines de transformer la technologie mondiale. Israël, nation de six ans entourée d'ennemis, construisit l'un des premiers ordinateurs du monde et devint la « nation des startups ».

Cette cinquième partie poursuit le voyage commencé dans l'Antiquité, le Moyen-Âge, les Temps Modernes et l'ère des révolutions. Six continents, soixante-cinq ans d'histoire — et partout la même question : qui hérite de la révolution numérique, et qui en est exclu ?

Afrique — L'arbre à palabres numérique

Dans chaque village africain, il existe un arbre sous lequel on se rassemble pour décider ensemble. L'arbre à palabres.

Ubuntu : « Je suis parce que nous sommes. » Cette philosophie africaine de l'intelligence collective contenait, sans le savoir, les principes des systèmes distribués et des protocoles de consensus. Mark Shuttleworth, milliardaire sud-africain devenu deuxième touriste spatial de l'histoire, nomma son système d'exploitation Ubuntu Linux — l'arbre à palabres devenu code informatique.

L'Afrique inventa le paiement mobile avec M-Pesa avant que l'Occident n'y pense. Elle créa Ushahidi, la cartographie citoyenne utilisée lors du tremblement de terre en Haïti. Rose Dieng-Kuntz, première femme africaine admise à Polytechnique, devint pionnière du web sémantique. Timnit Gebru révéla que les systèmes de reconnaissance faciale erraient jusqu'à trente-cinq pour cent pour les femmes à peau foncée. L'Afrique nous enseigne que l'innovation peut surgir des marges — et que les biais de l'IA portent la trace de ceux qui l'ont conçue.

Amériques — La forge et l'oubli

En 1956, vingt et un chercheurs se réunirent à Dartmouth College. Ils pensaient créer une intelligence artificielle en une génération. Ils se trompaient — de beaucoup.

L'Amérique du Nord connut des étés et des hivers de l'IA. L'été fondateur de Dartmouth. Le premier hiver quand les promesses ne se réalisèrent pas. L'été des systèmes experts. Leur effondrement. Puis la renaissance avec l'apprentissage profond. Pendant ce temps, Betty Holberton et les programmeuses de l'ENIAC restaient dans l'ombre des photos officielles.

Mais d'autres forges s'allumaient plus au sud. Le Mexique créa le premier master en informatique d'Amérique latine. L'Argentine eut ses pionnières de ComIC — Clarisa Cortes, Cristina Zoltán, Liana Lew, Noemí García. Le Brésil fabriqua soixante-sept pour cent de ses ordinateurs localement. Et le Chili rêva de Cybersyn — un Internet socialiste avant l'heure, détruit par le coup d'État de 1973. Les Amériques nous enseignent que l'histoire de l'IA est faite de cycles — et que certaines forges furent éteintes de force.

Asie — Les chemins parallèles convergent

Les voies ferrées semblent converger à l'horizon. C'est une illusion d'optique — les rails ne se touchent jamais. Mais cette illusion raconte une vérité : des chemins séparés peuvent mener au même endroit.

Le Japon passa de la copie à l'innovation — et du triomphe à l'échec. Le projet Fifth Generation promettait une révolution ; il devint « la génération perdue ». Mais la robotique japonaise, elle, conquit le monde : soixante-dix pour cent de la production mondiale en 1980. L'Inde sauta par-dessus le matériel pour devenir géante du logiciel grâce au bogue de l'an 2000. Morris Chang, « mis au placard » chez Texas Instruments à cinquante-quatre ans, partit pour Taïwan et inventa TSMC — le « bouclier de silicium » qui fabrique aujourd'hui les puces du monde entier. La Chine protégea son marché et fit émerger Lenovo, Huawei, les géants du BAT.

Fei-Fei Li créa ImageNet depuis Stanford. Kai-Fu Lee développa la reconnaissance vocale. L'Asie nous enseigne que les chemins parallèles finissent par converger — et que la domination technologique peut changer de continent.

Europe — La reconstruction numérique

L'Europe inventa l'ordinateur deux fois. La première fois dans le secret. La seconde dans l'oubli.

Konrad Zuse construisit le Z3 à Berlin en 1941 — le premier ordinateur programmable au monde. Un bombardement le détruisit. Tommy Flowers livra Colossus en 1944 — le premier ordinateur électronique. On lui ordonna de brûler les plans. Quand l'histoire fut écrite, l'Amérique avait tout inventé.

Puis vint le rapport Lighthill. En 1973, un mathématicien britannique saborda l'IA de son propre pays. Le premier « hiver de l'intelligence artificielle » commença.

Mais l'Europe se reconstruisit. Alain Colmerauer inventa Prolog à Marseille. Tim Berners-Lee créa le World Wide Web au CERN. Linus Torvalds écrivit Linux en Finlande. Yann LeCun posa les bases des réseaux de neurones convolutionnels. DeepMind, fondée à Londres, battrait le champion du monde de go. L'Europe nous enseigne la résilience — la capacité de tomber, de se relever, et de recommencer.

Moyen-Orient — Les jardins du désert

On n'attend pas de fleurs dans le désert. Pourtant, c'est là qu'elles poussent le plus vite — quand la pluie vient enfin.

En 1954, un pays de six ans d'existence entreprit de construire un ordinateur. Le comité consultatif comptait Einstein et von Neumann. Les candidats avaient parfois perdu leurs diplômes dans la Shoah. En 1955, le WEIZAC exécuta son premier calcul. Israël devint, un demi-siècle plus tard, la « nation des startups » — Check Point, ICQ, Waze, Mobileye.

Lotfi Zadeh naquit à Bakou, grandit à Téhéran, inventa la logique floue à Berkeley. L'Iran avait formé l'un des pères de l'IA. L'histoire l'oublia. Les Émirats plantèrent les graines d'une ambition numérique — Dubai Internet City, Masdar Institute — qui fleurirait après 2010. Le Moyen-Orient nous enseigne que la nécessité est mère de l'invention — et que les jardins peuvent pousser dans le désert.

Océanie — Les antipodes de l'innovation

Les grandes inventions naissent parfois là où personne ne les attend.

En 1949, l'Australie construisit le cinquième ordinateur à programme enregistré du monde. Trevor Pearcey et son équipe travaillèrent « largement indépendamment des efforts européens et américains ». L'isolement devint un avantage. En 1948, Pearcey prédit Internet. En 1950, le CSIRAC joua de la musique — le premier concert numérique de l'histoire.

Graeme Clark, dont le père était sourd, inventa l'implant cochléaire. Plus d'un million de personnes entendent aujourd'hui grâce à lui. Le CSIRO développa une technique de transmission sans fil qui devint un composant du WiFi — et gagna quatre cent cinquante millions de dollars face à quatorze géants de la tech. Google Maps naquit à Sydney. Atlassian devint la première licorne tech australienne.

L'Océanie nous enseigne que l'isolement peut être une force — et que les antipodes peuvent inventer des ponts vers le monde entier.

Ces six récits dessinent une géographie de l'innovation où les bonds par-dessus l'abîme côtoient les chutes et les reconstructions. Ils révèlent que la période 1945-2010 fut à la fois le moment où l'intelligence artificielle prit forme — étés d'euphorie, hivers de désillusion, renaissance de l'apprentissage profond — et le moment où les cartes du pouvoir technologique commencèrent à se redessiner.

L'Amérique du Nord nous a donné Dartmouth, la Silicon Valley, les cycles de l'IA. L'Afrique nous a donné l'innovation frugale et la question des biais algorithmiques. L'Asie nous a donné la convergence des chemins parallèles et le bouclier de silicium taïwanais. L'Europe nous a donné la résilience — le Web, Linux, les réseaux de neurones. Le Moyen-Orient nous a donné la nation des startups et la logique floue. L'Océanie nous a donné l'implant cochléaire et la preuve que l'isolement peut être une force.

La période s'achève au seuil d'une nouvelle révolution. En 2006, Geoffrey Hinton et ses étudiants relancèrent les réseaux de neurones profonds. En 2009, Fei-Fei Li publia ImageNet. En 2012, AlexNet prouva que l'apprentissage profond fonctionnait. L'hiver était fini. L'été qui s'ouvrait serait le plus long et le plus transformateur de l'histoire de l'IA.

Mais cette révolution hérite de tout ce qui précède — y compris des bonds et des chutes, des innovations frugales et des forges éteintes, des biais qui se perpétuent et des chemins parallèles qui convergent enfin.

Comprendre cet héritage — y compris ce qu'il a construit et ce qu'il a oublié — est peut-être la condition pour façonner ce qui vient.