Asie

Illustrations

1 / 5

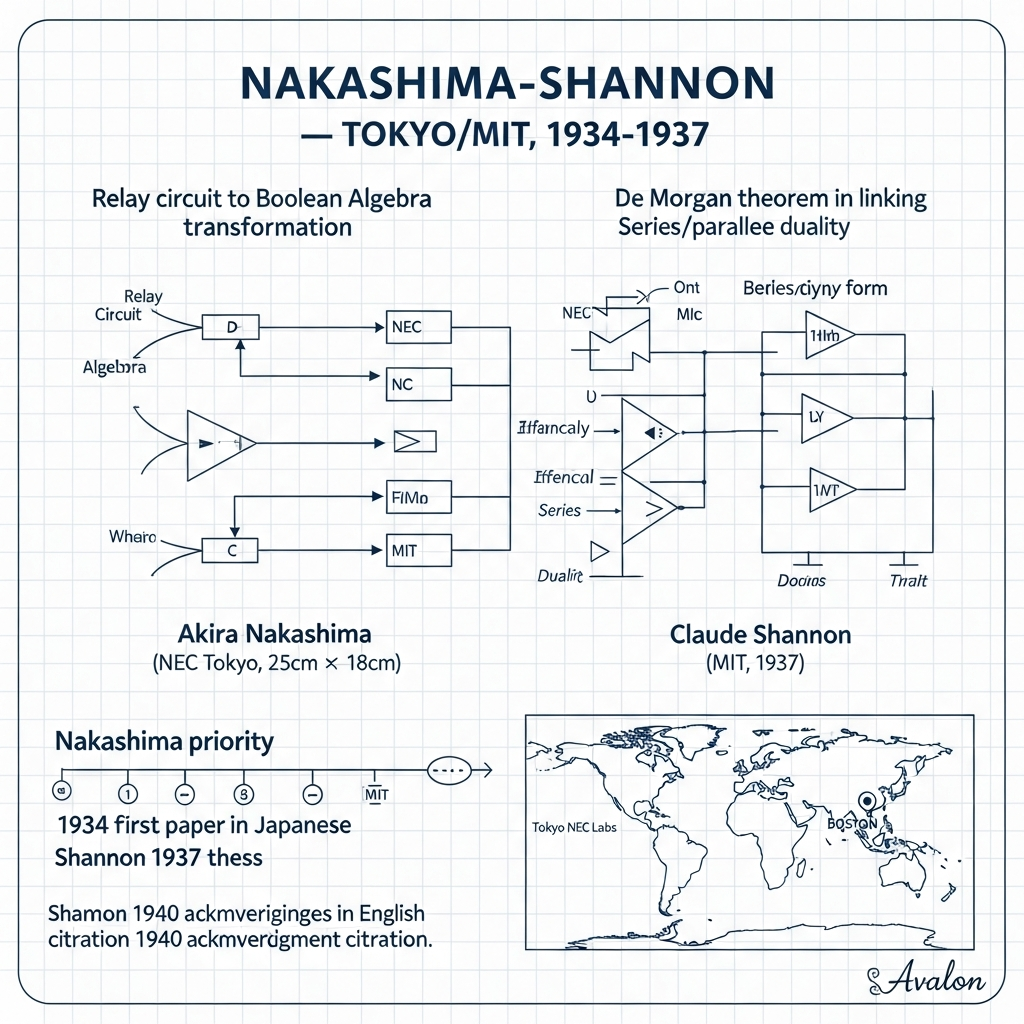

Akira Nakashima et Claude Shannon : deux hommes, deux continents, la même découverte sur l'algèbre booléenne et les circuits électriques (1935-1937).

Les chemins parallèles

L'Asie et les fondations de l'intelligence artificielle (1945-2010)

Hier — Les voies jumelles

Les grandes découvertes ne surviennent jamais qu'une seule fois. Elles émergent simultanément, en des lieux qui s'ignorent — comme si le temps lui-même murmurait la même idée à plusieurs oreilles à la fois.

En 1937, un étudiant du MIT soutint ce que certains considèrent comme la thèse de maîtrise la plus importante du vingtième siècle. Claude Shannon y démontrait que l'algèbre booléenne — ce système logique inventé un siècle plus tôt — pouvait décrire parfaitement le fonctionnement des circuits électriques. La même découverte avait déjà été faite. À Tokyo, entre 1934 et 1936, un ingénieur nommé Akira Nakashima avait publié une série d'articles montrant exactement la même chose. Shannon lut ces articles. Il les cita dans sa thèse. Puis il devint une légende.

Nakashima fut oublié.

Deux hommes, deux continents, la même idée. L'un partit des mathématiques abstraites, l'autre de l'ingénierie électrique. L'un écrivait en anglais dans une université américaine prestigieuse, l'autre en japonais pour une revue industrielle. L'un reçut tous les honneurs ; l'autre retourna à son travail chez NEC et disparut de l'histoire. Ce double destin résume quelque chose d'essentiel sur l'Asie et l'informatique : les chemins parallèles, les découvertes simultanées, les destins divergents.

Car l'Asie n'a pas attendu l'Occident pour penser le calcul et les machines.

En Inde, un statisticien nommé Prasanta Chandra Mahalanobis avait inventé dès 1930 une mesure qui porte aujourd'hui son nom : la distance de Mahalanobis. Cette formule mathématique — qui calcule l'écart entre un point et une distribution en tenant compte des corrélations entre variables — est encore utilisée chaque jour dans l'apprentissage automatique contemporain. Quand un algorithme détecte une anomalie dans un jeu de données, quand un système de reconnaissance de formes identifie un visage, il y a de fortes chances qu'il utilise, sans le savoir, l'héritage de ce mathématicien bengali né sous l'Empire britannique.

Mahalanobis fonda en 1931 l'Indian Statistical Institute à Calcutta. Plus tard, il créa le National Sample Survey, qui devint l'épine dorsale de la planification économique indienne. Le 29 juin est célébré en Inde comme Journée nationale des statistiques, en son honneur. Mais dans l'histoire mondiale de l'intelligence artificielle, son nom apparaît rarement. Un autre chemin parallèle.

Et il y avait Homi Jehangir Bhabha.

Bhabha était physicien nucléaire, mais sa vision dépassait l'atome. Il croyait que l'Inde devait développer ses propres compétences en haute technologie plutôt que de dépendre éternellement de l'étranger. En 1945, avec le soutien de la famille Tata, il fonda à Bombay le Tata Institute of Fundamental Research — un centre de recherche qui allait produire le premier ordinateur entièrement conçu et fabriqué en Inde.

Le développement commença en 1955. Les ingénieurs indiens travaillaient sans modèle à copier, sans experts étrangers pour les guider. Ils partirent du design de la machine IAS — la conception théorique élaborée à Princeton — et construisirent tout eux-mêmes. Deux mille sept cents tubes à vide. Mille sept cents diodes au germanium. Douze mille cinq cents résistances. Une machine qui consommait vingt kilowatts d'électricité et devait fonctionner en deux équipes par jour pour répondre à la demande des chercheurs.

En 1960, le premier ministre Jawaharlal Nehru inaugura officiellement cette machine et lui donna son nom : TIFRAC, pour Tata Institute of Fundamental Research Automatic Calculator. L'Inde avait construit son premier ordinateur — non pas en achetant une technologie étrangère, mais en la créant de ses propres mains.

Six ans plus tard, Bhabha mourut dans un accident d'avion sur le Mont Blanc. L'Inde perdit un visionnaire, un leader capable de convaincre le gouvernement de faire de grands paris technologiques. Certains pensent que sans cette mort prématurée, le pays aurait emprunté un chemin différent — peut-être celui de la fabrication de matériel informatique plutôt que celui des services logiciels. Nous ne le saurons jamais. L'histoire ne repasse pas les plats.

Pendant ce temps, le Japon empruntait un autre chemin — celui du transfert technologique organisé.

Après 1945, le Japon était en ruines. Les chercheurs manquaient d'équipement, parfois même de nourriture. Le pays était occupé par les forces alliées. Les voyages internationaux étaient difficiles. L'accès aux devises étrangères, limité. Pourtant, certains fonctionnaires du ministère du Commerce international et de l'Industrie — le MITI — entrevirent une opportunité dans l'invention du transistor par les laboratoires Bell en 1948.

Ils organisèrent l'acquisition systématique de cette technologie. Les entreprises japonaises obtinrent des licences américaines. Elles apprirent. Elles copièrent. Puis elles innovèrent.

En 1957, Sony produisit la première radio entièrement transistorisée au monde — marquant l'entrée du Japon dans l'électronique mondiale. En 1960, le pays dépassait les États-Unis avec plus de cent millions de transistors produits par an. Le chemin du transfert technologique avait porté ses fruits.

Mais le MITI ne se contentait pas d'importer des technologies. Il protégeait aussi le marché intérieur. Quand Texas Instruments déposa quatorze brevets au Japon en 1960, la bureaucratie refusa simplement de les traiter — pendant des années. Le temps que les brevets soient accordés, les entreprises japonaises avaient eu le temps de copier et d'améliorer les inventions américaines. C'était une stratégie délibérée : bloquer les produits étrangers qui n'incluaient pas de transfert de technologie.

En 1976, le MITI lança le projet VLSI — pour « Very Large Scale Integration », intégration à très grande échelle. NEC, Hitachi, Fujitsu et d'autres entreprises concurrentes furent rassemblées pour un programme de recherche et développement conjoint sur les circuits intégrés. Le projet dura quatre ans. À la fin des années 1980, le Japon détenait cinquante pour cent du marché mondial des semi-conducteurs.

Les chemins parallèles avaient convergé — pour un temps.

Aujourd'hui — Les bonds et les chutes

Il existe plusieurs façons de rattraper un retard technologique. On peut copier. On peut acheter. On peut protéger son marché et attendre. Ou on peut sauter par-dessus l'obstacle.

L'Inde choisit le saut.

Dans les années 1980, le pays avait manqué le virage du matériel informatique. Les ordinateurs indiens n'avaient pas trouvé de marché mondial. La mort de Bhabha, les restrictions économiques, le manque de capitaux — les causes étaient multiples. Mais en 1991, quand l'Inde ouvrit son économie, une nouvelle opportunité apparut.

Les entreprises américaines avaient un problème. Leurs vieux systèmes informatiques utilisaient un langage de programmation appelé COBOL, inventé dans les années 1960. Ce langage stockait les dates sur deux chiffres seulement — 99 pour 1999, par exemple. Que se passerait-il quand l'horloge passerait à l'an 2000 ? Les systèmes afficheraient-ils 00, croyant être revenus en 1900 ? Des milliards de lignes de code devaient être vérifiées et corrigées. Mais aux États-Unis, COBOL était devenu obsolète. Plus personne ne l'enseignait. Il n'y avait pas assez de programmeurs.

En Inde, COBOL était encore au programme des universités. Les curricula étaient en retard sur leur temps — mais ce retard devenait soudain un avantage. L'Inde avait des programmeurs qui savaient corriger le code que les Américains ne savaient plus lire.

Le « bogue de l'an 2000 » devint la rampe de lancement de l'industrie informatique indienne. TCS — Tata Consultancy Services — dépassa le milliard de dollars d'exportations à la fin des années 1990. L'industrie indienne des services informatiques tira deux milliards trois cents millions de dollars des seuls efforts liés à l'an 2000. Le nombre d'entreprises enregistrées dans les parcs technologiques logiciels passa de deux cents en 1995 à près de huit cents en 2000.

Bangalore — cette ville où Mahalanobis avait établi un centre de l'Indian Statistical Institute dans les années 1960 — devint la « Silicon Valley de l'Inde ». Non pas en fabriquant des puces, mais en écrivant du code. L'Inde avait sauté par-dessus l'étape du matériel pour devenir une géante du logiciel.

Infosys, Wipro, TCS — ces noms devinrent synonymes de l'externalisation informatique mondiale. En 2017, Bangalore représentait trente-huit pour cent des exportations informatiques indiennes — quarante-cinq milliards de dollars. Un million d'emplois directs. Trois millions d'emplois indirects.

Le chemin du logiciel avait mené plus loin que celui du matériel.

À Taïwan, un autre bond se préparait — mais celui-ci allait transformer l'industrie mondiale des semi-conducteurs.

Morris Chang était né à Ningbo, en Chine, en 1931. Il avait fait ses études à Harvard, au MIT, à Stanford. Pendant vingt-cinq ans, il avait gravi les échelons de Texas Instruments jusqu'à devenir vice-président senior en charge des semi-conducteurs mondiaux. Puis, en 1983, sa carrière s'arrêta. Transféré à une division en difficulté, puis à un poste sans responsabilités, il comprit qu'il avait été « mis au placard ».

Il quitta l'entreprise. À cinquante-quatre ans, sa carrière semblait terminée.

Deux ans plus tard, le gouvernement de Taïwan le recruta pour diriger l'Institut de recherche en technologie industrielle. On lui demanda de développer l'industrie naissante des semi-conducteurs de l'île. Chang eut une idée que personne n'avait eue avant lui.

À l'époque, les entreprises de semi-conducteurs faisaient tout : conception et fabrication. Intel, AMD, Texas Instruments — toutes possédaient leurs propres usines. Mais construire une usine de semi-conducteurs coûtait des milliards de dollars. C'était une barrière infranchissable pour les nouveaux entrants.

Chang proposa l'inverse : une entreprise qui ne ferait que fabriquer — jamais concevoir. Un « fondeur pur » qui accepterait les designs de n'importe quel client et les transformerait en puces. Les concepteurs n'auraient plus besoin d'usines. Ils pourraient se concentrer sur l'innovation.

En 1987, à cinquante-cinq ans, Chang fonda TSMC — Taiwan Semiconductor Manufacturing Company. Le gouvernement apporta près de la moitié du capital. Philips transféra sa technologie en échange d'une participation au capital. Intel fut le premier client américain, envoyant un signal fort au marché.

Le modèle « sans usine » — fabless en anglais — rendit possible l'existence d'entreprises qui n'auraient jamais pu exister autrement. NVIDIA, AMD, MediaTek — toutes ces entreprises qui conçoivent des puces sans posséder d'usines doivent leur existence à l'invention de Morris Chang.

Aujourd'hui, TSMC détient soixante-quatre pour cent du marché mondial des fonderies. L'entreprise fabrique les puces qui alimentent les systèmes d'intelligence artificielle de NVIDIA, Meta, Amazon. On l'appelle parfois le « bouclier de silicium » de Taïwan — car aucune puissance mondiale ne peut se permettre de perdre l'accès à ses usines.

Morris Chang prit sa retraite en 2018, à quatre-vingt-sept ans. L'homme qui avait été mis au placard à cinquante-trois ans avait créé l'entreprise la plus importante de l'industrie des semi-conducteurs.

Mais tous les bonds ne réussissent pas. Et le Japon allait l'apprendre à ses dépens.

En 1982, le MITI lança son projet le plus ambitieux : le Fifth Generation Computer Systems — les systèmes informatiques de cinquième génération. L'objectif était de créer un « ordinateur révolutionnaire » capable d'inférer à partir d'instructions incomplètes, d'utiliser les connaissances qu'il avait accumulées, de raisonner comme un humain. Une intelligence artificielle avant l'heure.

Le Japon choisit de baser ce système sur le langage de programmation Prolog — plutôt que sur Lisp, utilisé par les chercheurs américains. Il investit des centaines de millions de dollars. Il créa un institut dédié, l'ICOT, financé par toutes les grandes entreprises japonaises de l'informatique.

Dix ans plus tard, le projet fut déclaré terminé. Pas terminé au sens de « accompli ». Terminé au sens de « abandonné ».

L'industrie avait évolué si rapidement que le chemin technologique choisi en 1982 était devenu obsolète en 1992. La loi de Moore — ce principe selon lequel la puissance des processeurs double tous les dix-huit mois — avait rendu les ordinateurs standard plus rapides que les machines parallèles spécialisées du projet. Les processeurs Intel, produits en masse, battaient les architectures sophistiquées conçues par l'ICOT.

Le New York Times titra : « La cinquième génération est devenue la génération perdue du Japon. »

Le projet laissa un héritage : des contributions théoriques à la programmation logique, une génération d'ingénieurs formés. Mais il laissa aussi une leçon. L'ambition technologique peut mener à l'impasse. Prédire l'avenir est plus difficile qu'il n'y paraît. Et parfois, les chemins parallèles ne mènent nulle part.

Pendant ce temps, la Chine suivait son propre chemin — plus long, plus sinueux, mais peut-être plus solide.

Le premier ordinateur chinois fut construit en 1958 — une copie d'un modèle soviétique. La Chine dépendait alors entièrement de l'URSS pour les composants qu'elle ne savait pas fabriquer. En 1960, la rupture sino-soviétique changea tout. Moscou rappela ses experts, qui emportèrent documents et équipements. De nombreux projets de recherche durent s'arrêter du jour au lendemain.

Les ingénieurs chinois continuèrent seuls. Les ordinateurs qu'ils développèrent après 1960 ne ressemblaient ni aux machines soviétiques ni aux machines américaines. C'étaient des créations distinctement chinoises — nées de la nécessité.

Puis vint la Révolution culturelle. De 1966 à 1976, la plupart des recherches scientifiques furent forcées de s'arrêter. Les scientifiques furent envoyés dans des camps de rééducation. Les universités fermèrent. Le chaos politique engloutit le pays.

Et pourtant. En 1968, malgré tout, les usines chinoises commencèrent à fabriquer des circuits intégrés. En 1970, l'Institut de recherche informatique de Pékin produisit l'ordinateur 111, atteignant une vitesse de cent quatre-vingts kiloflops — un progrès remarquable dans un pays en plein effondrement politique.

La résilience chinoise était faite de ce paradoxe : avancer malgré les obstacles, construire malgré la destruction.

Après 1978, quand Deng Xiaoping ouvrit le pays, une immense quantité d'avancées scientifiques devint disponible du jour au lendemain. La Chine rattrapa en quelques années des décennies de retard. En 1984, Lenovo émergea de la « Rue de l'électronique » de Pékin. En 1987, un ancien officier de l'armée nommé Ren Zhengfei fonda Huawei avec vingt et un mille yuans de capital — environ trois mille dollars.

Puis vinrent les géants d'Internet. Tencent en 1998. Alibaba en 1999. Baidu en 2000. Tous financés par du capital-risque étranger — de Hong Kong, de Boston, de la Silicon Valley. Tous protégés par la « Grande Muraille numérique » qui bloquait Google, Facebook et les autres concurrents occidentaux.

En 2005, la Chine comptait cent onze millions d'utilisateurs d'Internet. Entre 1991 et 2016, le financement gouvernemental de la recherche et du développement fut multiplié par trente. En 2009, la Chine dépassa le Japon en dépenses de R&D.

Le chemin chinois était différent de tous les autres. Ni le saut indien, ni le transfert japonais, ni l'invention taïwanaise. Une combinaison unique : patience, protection, investissement massif. Et une résilience forgée dans les épreuves.

Au-delà — La convergence

Les chemins parallèles, à l'horizon, semblent toujours se rejoindre.

Regardons où nous en sommes. Les puces qui alimentent l'intelligence artificielle contemporaine sont fabriquées principalement en Asie — par TSMC à Taïwan, par Samsung en Corée du Sud. Les robots qui assemblent ces puces viennent du Japon — FANUC, Yaskawa, Kawasaki produisent quarante-cinq pour cent des robots industriels mondiaux. Les données qui entraînent les modèles d'IA sont annotées par des travailleurs du monde entier, mais les algorithmes qui les traitent ont souvent été conçus par des chercheurs nés en Asie.

Fei-Fei Li est née en Chine en 1976. Elle arriva aux États-Unis à seize ans, travailla dans des pressings et des restaurants pour aider sa famille, devint professeure d'informatique à Princeton puis à Stanford. En 2009, elle créa ImageNet — un jeu de données de douze millions d'images classées en vingt-deux mille catégories. Quand elle présenta le projet, personne ne s'y intéressa. Trois ans plus tard, ImageNet devint le catalyseur de la révolution de l'apprentissage profond. On la surnomme aujourd'hui la « marraine de l'IA ».

Kai-Fu Lee est né à Taïwan en 1961. Sa thèse de doctorat à Carnegie Mellon produisit le premier système de reconnaissance vocale continue, indépendant du locuteur, à large vocabulaire. En 1988, il créa un programme qui battit le champion du monde d'Othello — l'un des premiers exemples d'un ordinateur surpassant l'humain dans un jeu. Il dirigea ensuite les divisions d'intelligence artificielle d'Apple et de Microsoft, fonda Microsoft Research China — qui forma la majorité des leaders actuels de l'IA chinoise —, puis présida Google China. Aujourd'hui, son fonds de capital-risque investit dans la prochaine génération de startups d'intelligence artificielle chinoises.

Ces trajectoires individuelles sont des métaphores de quelque chose de plus large. L'Asie n'est plus seulement le lieu où l'on fabrique les machines. Elle est de plus en plus le lieu où l'on conçoit l'intelligence qui les anime.

La distance de Mahalanobis, inventée en 1930 par un statisticien bengali, est utilisée chaque jour dans les algorithmes de détection d'anomalies. La théorie des circuits de commutation, découverte indépendamment par Nakashima en 1935, reste le fondement de toute l'électronique numérique. Le modèle du fondeur pur, inventé par Morris Chang en 1987, permet à l'industrie de l'IA d'exister sous sa forme actuelle.

Ces contributions n'étaient pas des copies. Elles n'étaient pas des transferts. Elles étaient des créations originales — nées de circonstances différentes, mais répondant aux mêmes questions fondamentales.

Le projet Fifth Generation fut un échec commercial. Mais il posa des questions que nous nous posons encore : comment faire raisonner une machine ? Comment lui permettre d'inférer à partir d'informations incomplètes ? Comment créer une intelligence qui ne soit pas seulement un calcul, mais une compréhension ?

Ces questions n'ont pas de réponse définitive. Nous tâtonnons encore. Les chemins parallèles continuent de se tracer — certains mènent à des impasses, d'autres à des révolutions.

Ce qui a changé, peut-être, c'est la direction. Pendant des décennies, l'Asie a importé, copié, adapté les technologies occidentales. Elle a appris en faisant. Elle a rattrapé son retard par le transfert, la protection, le saut. Aujourd'hui, le mouvement s'inverse. Les chercheurs asiatiques ne sont plus des suiveurs. Ils sont au centre.

La Chine investit des centaines de milliards dans l'intelligence artificielle. L'Inde forme des millions d'ingénieurs. Le Japon reste le maître incontesté de la robotique. Taïwan fabrique les puces sans lesquelles rien ne fonctionne. Singapour s'est transformée en hub de l'innovation — passant de l'industrie intensive en main-d'œuvre des années 1960 à l'économie de la connaissance des années 2000.

Les chemins parallèles convergent.

Nakashima et Shannon avaient découvert la même vérité, chacun de son côté du Pacifique. L'un fut célébré, l'autre oublié. Mais la vérité elle-même — que l'algèbre booléenne pouvait décrire les circuits électriques — était universelle. Elle n'appartenait à aucun continent.

L'intelligence artificielle, elle aussi, est universelle. Elle ne parle pas anglais plus naturellement que chinois ou hindi. Elle ne pense pas « occidental » ou « oriental ». Elle est le produit de contributions venues de partout — de Mahalanobis à Nakashima, de Bhabha à Chang, de Fei-Fei Li à Kai-Fu Lee.

L'histoire de l'Asie et de l'intelligence artificielle n'est pas terminée. Elle ne fait que commencer. Les chemins parallèles ne se sont pas encore rejoints à l'horizon.

Mais ils s'en approchent.