Europe

Illustrations

1 / 5

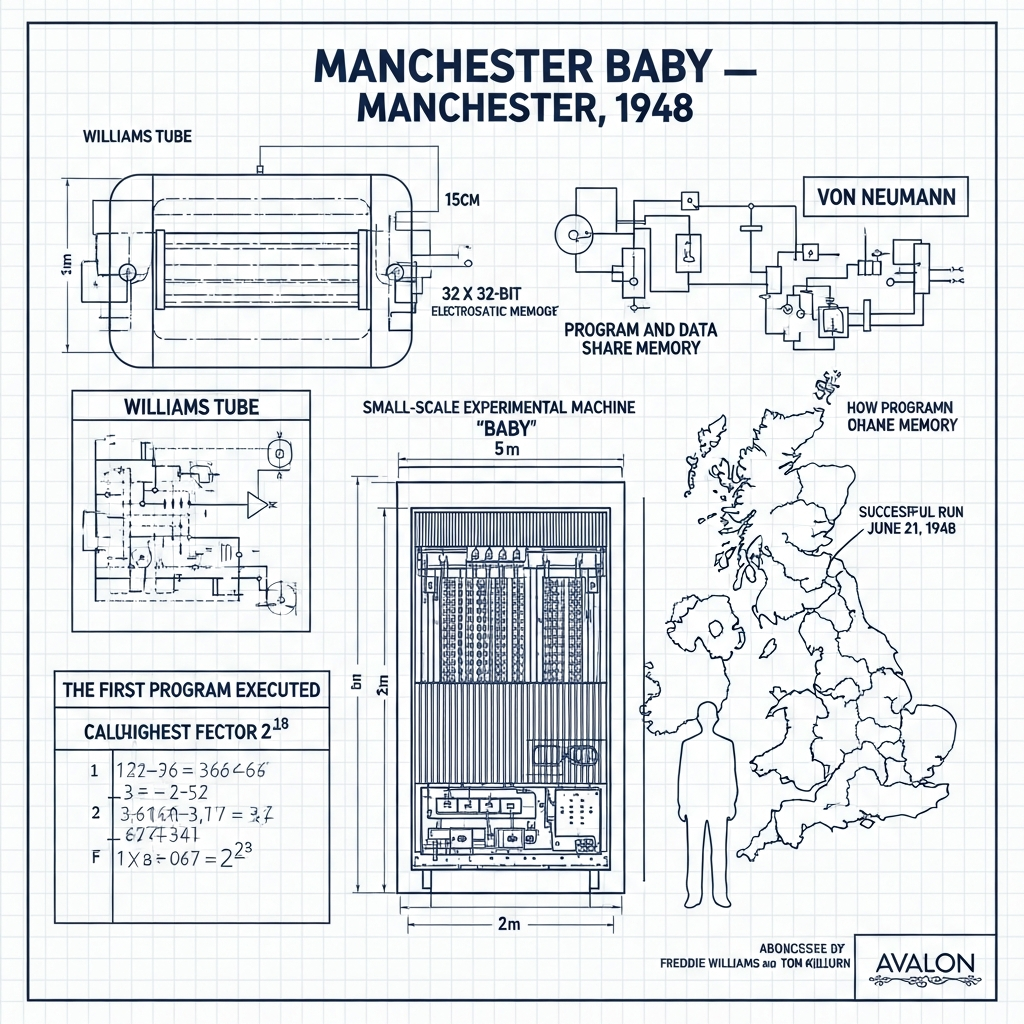

Le Small-Scale Experimental Machine (1948) : le « Bébé » de Manchester, premier ordinateur à stocker son programme en mémoire.

La reconstruction numérique

L'Europe et les fondations de l'intelligence artificielle (1945-2010)

Des ruines à la renaissance : l'informatique européenne entre deux guerres

Hier — Les pionniers des décombres

L'Europe inventa l'ordinateur deux fois. La première fois dans le secret. La seconde dans l'oubli.

En 1941, dans un appartement de Berlin, un jeune ingénieur civil nommé Konrad Zuse acheva une machine qu'il avait construite seul, avec l'aide de quelques amis et de sa famille. Le Z3 occupait un salon entier : deux mille six cents relais électromécaniques, des kilomètres de câbles, un système de lecture par film perforé. La machine calculait en binaire — une innovation que Zuse avait développée par intuition, ignorant que des mathématiciens américains travaillaient sur les mêmes principes. Le régime nazi ne s'y intéressa pas. La Wehrmacht voulait des armes, pas des calculateurs. Zuse continua ses travaux dans l'indifférence générale.

Le 21 décembre 1943, un bombardement allié détruisit le Z3. Trois ans plus tard, quand les historiens commencèrent à écrire l'histoire de l'informatique, ils parlèrent de l'ENIAC américain, du Colossus britannique, des travaux d'Alan Turing. Le nom de Zuse fut à peine mentionné. L'Allemagne avait perdu la guerre. Elle perdrait aussi la mémoire de ses inventions.

À quelques centaines de kilomètres de Berlin, dans un manoir anglais entouré de barbelés, une autre révolution se préparait. Bletchley Park abritait le centre de décryptage britannique — le cœur secret de l'effort de guerre allié. Alan Turing y arriva le 4 septembre 1939, un jour après la déclaration de guerre. Il prit la direction de la Hut 8, chargée de briser les codes navals allemands. Avec Gordon Welchman, il conçut la Bombe, une machine électromécanique capable de percer les secrets de la machine Enigma. La première Bombe fut opérationnelle le 18 mars 1940. Des centaines suivirent.

Mais la véritable percée vint d'un ingénieur du General Post Office nommé Tommy Flowers. En janvier 1944, il livra Colossus, une machine électronique conçue pour décrypter le chiffre Lorenz — plus complexe encore qu'Enigma. Colossus Mark 2 devint opérationnel le 1er juin 1944, cinq jours avant le Débarquement en Normandie. Dix Colossus fonctionnaient à la fin de la guerre. Ils contribuèrent à la victoire. Puis ils furent détruits.

L'existence de Colossus resta classifiée jusqu'aux années 1970. Quand le secret fut enfin levé, les manuels d'histoire avaient déjà été écrits. L'ENIAC américain, présenté en 1946 avec grand fracas médiatique, était devenu « le premier ordinateur électronique ». Colossus, antérieur de deux ans, n'existait pas officiellement. Les femmes qui avaient constitué soixante-quinze pour cent du personnel de Bletchley Park — cryptanalystes, opératrices, mathématiciennes — furent à peine mentionnées.

L'Europe gagnait ses guerres et perdait sa mémoire.

Manchester : la naissance du programme enregistré

Dans les ruines de l'après-guerre, l'invention continua.

Le 21 juin 1948, dans un laboratoire de l'Université de Manchester, une machine de deux mètres de haut et cinq mètres de long exécuta son premier programme. Le Small-Scale Experimental Machine — que ses créateurs appelaient « le Bébé » — n'était pas très impressionnant. Il pesait près d'une tonne, consommait trois mille cinq cents watts, et sa mémoire pouvait stocker exactement trente-deux mots de trente-deux bits. Mais il accomplissait quelque chose qu'aucune machine n'avait fait avant lui : il stockait son programme dans sa propre mémoire et pouvait le modifier en cours d'exécution.

Frederic Williams, Tom Kilburn et Geoff Tootill avaient inventé le principe qui sous-tend tous les ordinateurs modernes — le programme enregistré. Ce principe, théorisé par Turing dans son article de 1936, prenait enfin forme physique. Le premier programme, écrit par Kilburn, cherchait le plus grand facteur de deux à la puissance dix-huit. Il fallut cinquante-deux minutes et trois millions et demi d'opérations pour trouver la réponse : cent trente et un mille soixante-douze.

Un an plus tard, le Manchester Mark 1 était opérationnel. En février 1951, Ferranti livra une version commerciale à l'université — le premier ordinateur commercial au monde, devançant de quelques mois l'UNIVAC américain. L'ironie voulut que les parents de Tim Berners-Lee — Conway et Mary Lee Woods — travaillèrent tous deux sur le Ferranti Mark 1. Leur fils inventerait le World Wide Web quarante ans plus tard.

Le Ferranti Mark 1 produisit aussi la première musique générée par ordinateur et l'un des premiers programmes d'échecs. Mais ces exploits furent vite oubliés. L'industrie informatique mondiale se construisait ailleurs — de l'autre côté de l'Atlantique, où IBM et ses concurrents américains accaparaient le marché.

Aujourd'hui — La longue reconstruction

Le premier hiver : quand l'Europe saborda son avenir

En 1963, Donald Michie — un vétéran de Bletchley Park qui y avait côtoyé Alan Turing — fonda un groupe de recherche en intelligence artificielle dans un appartement d'Édimbourg. « Il n'y avait qu'environ quatre endroits au monde faisant de l'IA dans les années 1960 », dira-t-il plus tard. Édimbourg en était un.

Michie construisit MENACE, une machine capable d'apprendre à jouer au morpion par renforcement. Son équipe développa les robots Freddy, capables d'assembler des jouets en intégrant perception et action. L'IA britannique était pionnière, inventive, ambitieuse.

Puis vint le rapport Lighthill.

En 1972, le Science Research Council britannique demanda à Sir James Lighthill — un mathématicien appliqué sans expérience en intelligence artificielle — d'évaluer l'état de la recherche. Son verdict, publié en 1973, fut dévastateur : « échec total à atteindre ses objectifs grandioses ». Le problème, selon Lighthill, était l'explosion combinatoire : les algorithmes d'IA fonctionnaient sur des exemples simples mais s'effondraient face à la complexité du monde réel. « Le robot polyvalent est un mirage », conclut-il.

Le 9 mai 1973, la BBC diffusa un débat où Lighthill affronta Michie, John McCarthy et Richard Gregory. Lighthill gagna — non pas sur le fond, mais sur l'effet. Le gouvernement britannique coupa les financements. Les laboratoires fermèrent. Des chercheurs changèrent de domaine ou émigrèrent. L'Europe venait de déclencher le premier « hiver de l'IA ».

Le paradoxe était cruel. Le Royaume-Uni avait inventé l'ordinateur à programme enregistré, le premier ordinateur commercial, posé les bases de l'intelligence artificielle académique. Et c'était le Royaume-Uni qui, d'un rapport de cinquante pages, sabordait sa propre recherche.

La bataille pour la souveraineté

Sur le continent, d'autres pays menaient une guerre différente — non pas contre l'IA, mais pour l'indépendance technologique.

En 1964, General Electric avait acquis la majorité de la Compagnie des Machines Bull, le fleuron de l'informatique française. L'« affaire Bull » traumatisa le gouvernement. Plus grave encore : les États-Unis refusèrent d'exporter des ordinateurs IBM et CDC au Commissariat à l'énergie atomique — la France ne devait pas perfectionner sa bombe H avec du matériel américain.

Le général de Gaulle réagit en juillet 1966 par le Plan Calcul. L'objectif : créer une industrie informatique nationale capable de rivaliser avec les géants américains. La CII (Compagnie Internationale pour l'Informatique) fut fondée. L'IRIA — futur INRIA — ouvrit ses portes en 1967 pour coordonner la recherche. Plus de cent millions de dollars furent investis en cinq ans.

Les résultats furent mitigés. La CII produisit des ordinateurs respectables — l'Iris 50 en 1967, l'Iris 80 en 1969. Des négociations avec Siemens et Philips donnèrent naissance à Unidata, un consortium européen qui livra ses premiers ordinateurs en 1974. Mais l'élection de Giscard d'Estaing, opposant au Plan Calcul, mit fin à l'aventure. Unidata fut liquidé. La CII fut absorbée dans Honeywell-Bull.

L'ambition de souveraineté s'était heurtée à la réalité économique. IBM dominait le marché mondial. Aucun constructeur européen ne pouvait rivaliser seul.

Prologue et les graines de l'IA

Pendant que les gouvernements bataillaient pour les gros systèmes, des chercheurs plantaient des graines plus discrètes.

À l'été 1972, dans un laboratoire de l'Université d'Aix-Marseille, Alain Colmerauer et Philippe Roussel achevèrent la première version d'un nouveau langage de programmation. Ils l'appelèrent Prolog — contraction de « PROgrammation en LOGique ». Colmerauer avait travaillé sur le traitement du langage naturel et la traduction automatique. Il voulait un outil capable de manipuler des règles logiques comme d'autres langages manipulaient des nombres.

Prolog permettait d'écrire des programmes sous forme de faits et de règles : « Socrate est un homme. Tous les hommes sont mortels. Donc Socrate est mortel. » La machine déduisait les conclusions. Le paradigme était radicalement différent des langages procéduraux comme FORTRAN ou COBOL.

Le langage attira l'attention du Japon. Quand le ministère japonais du Commerce international lança son ambitieux projet Fifth Generation Computer en 1982, il choisit Prolog comme langage de base. L'échec du projet — la « génération perdue du Japon », titra le New York Times en 1992 — entacha la réputation de Prolog. Mais le langage survécut. Cinquante ans plus tard, il reste la référence de la programmation logique, utilisé dans les systèmes experts, les preuves de théorèmes et le traitement du langage naturel.

La renaissance des années 1980

En 1983, le gouvernement britannique lança le programme Alvey — une réponse au Fifth Generation japonais et une tentative de réparer les dégâts du rapport Lighthill. Trois cent cinquante millions de livres, plus de trois cents projets, cent quinze entreprises, deux mille chercheurs au pic d'activité. Les responsables du programme évitèrent soigneusement le terme « intelligence artificielle », préférant parler de « systèmes intelligents à base de connaissances ». La blessure Lighthill n'était pas cicatrisée.

Les résultats furent mitigés — comme toujours avec les grands programmes technologiques. Mais Alvey créa un modèle de coopération industrie-académie qui inspira les programmes européens ultérieurs.

En 1984, la Communauté européenne lança ESPRIT — European Strategic Programme on Research in Information Technology. Cinq programmes successifs, de 1983 à 1998, financèrent des centaines de projets en microélectronique, génie logiciel, systèmes à base de connaissances et interface homme-machine. ESPRIT imposa une règle cruciale : pour recevoir des fonds, un projet devait impliquer au moins deux organisations de pays européens différents. La coopération n'était plus une option — c'était une condition.

De ces programmes émergea une génération de chercheurs formés à travailler par-delà les frontières. L'Europe n'avait pas rattrapé les États-Unis. Mais elle avait appris à collaborer.

De l'autre côté du rideau de fer

Pendant que l'Europe occidentale tentait de construire une industrie informatique face à la domination américaine, l'Union soviétique menait sa propre course.

Sergei Lebedev, à Kiev puis à Moscou, construisit le MESM en 1950 — le premier ordinateur programmable soviétique — puis le BESM, conçu pour surpasser l'ENIAC américain. Le BESM-6, opérationnel en 1965, était une machine remarquable : pipeline d'instructions, entrelacement mémoire, traduction d'adresses virtuelles. Trois cent cinquante-cinq exemplaires furent produits jusqu'en 1987. Le BESM-6 calcula les paramètres du système de défense antimissile soviétique.

Plus impressionnant encore : l'Elbrus. En 1978, les ingénieurs soviétiques construisirent un processeur superscalaire avec exécution hors-ordre, renommage de registres et exécution spéculative — des techniques que les processeurs occidentaux n'adopteraient que quinze ans plus tard. L'Elbrus équipa les centres nucléaires d'Arzamas-16 et Chelyabinsk-70.

Mais le secret militaire étouffa l'innovation. Les ordinateurs soviétiques les plus avancés restèrent confinés dans des bunkers. Aucun transfert vers l'économie civile n'eut lieu. Dans les années 1970, face au chaos bureaucratique et au retard en semi-conducteurs, le gouvernement soviétique prit une décision fatale : abandonner les conceptions originales pour cloner l'IBM System/360. L'URSS renonçait à son avenir informatique.

Au-delà — Le don européen

Le Web : cadeau au monde

En mars 1989, un informaticien britannique travaillant au CERN soumit à son supérieur une proposition de quelques pages. Tim Berners-Lee voulait résoudre un problème concret : comment permettre aux physiciens du monde entier de partager leurs données et leurs documents ? Sa solution combinait deux technologies existantes — l'Internet et l'hypertexte — en quelque chose de nouveau.

Son patron, Mike Sendall, griffonna sur la couverture : « Vague mais excitant. »

Fin 1990, Berners-Lee avait développé les trois piliers du Web : HTML pour afficher les pages, URL pour les identifier, HTTP pour les relier. Le premier serveur et le premier navigateur fonctionnaient sur son ordinateur NeXT. En août 1991, il annonça le projet sur les forums Internet. Le premier serveur américain apparut en décembre au Stanford Linear Accelerator Center.

Le 30 avril 1993, le CERN prit une décision qui changerait le monde : mettre le protocole Web dans le domaine public, libre de droits. Pas de brevets. Pas de licences. Un cadeau.

Si le Web avait été américain, il aurait probablement été breveté, licencié, monétisé. Une entreprise aurait prélevé une taxe sur chaque page, chaque lien, chaque transaction. L'histoire d'Internet aurait été différente — plus restreinte, plus contrôlée, plus inégale. Mais le Web était européen. Il naquit dans un laboratoire de recherche international financé par des fonds publics. Et il fut offert à l'humanité.

Linux : la cathédrale et le bazar

En Finlande, un étudiant de vingt et un ans travaillait sur un autre projet.

Linus Torvalds avait grandi avec un VIC-20, programmant en BASIC puis en code machine dès l'âge de onze ans. En 1991, il acheta un PC compatible IBM avec un processeur Intel 80386 et installa MINIX, un système d'exploitation éducatif. Frustré par ses limitations, il décida d'écrire le sien.

Le 25 août 1991, il annonça son projet sur un groupe de discussion : « Je fais un système d'exploitation (libre) (juste un hobby, ne sera pas grand et professionnel comme gnu) pour les clones AT 386. » Le message était modeste. Le projet ne l'était pas.

Torvalds voulait appeler son système Freax — contraction de « free », « freak » et « x » (comme Unix). Ari Lemmke, administrateur du serveur FTP de l'université, trouva le nom ridicule et le remplaça par « Linux ». Torvalds protesta. Lemmke refusa de changer. Linux resta.

En janvier 1992, Torvalds relicencia son noyau sous la GNU General Public License. Le code devint vraiment libre — non seulement gratuit, mais modifiable et redistribuable par quiconque. Des milliers de développeurs à travers le monde commencèrent à contribuer. En 1994, la version 1.0 était prête.

Linux ne conquit jamais le bureau — Windows y règne encore. Mais il conquit tout le reste. Les serveurs web, les téléphones Android, les superordinateurs, les objets connectés, les voitures autonomes. Aujourd'hui, la quasi-totalité de l'infrastructure numérique mondiale tourne sur un noyau écrit par un Finlandais de vingt et un ans qui voulait juste « un hobby ».

Nokia : l'ascension et la chute

La Finlande produisit une autre révolution — et un avertissement.

Nokia était née en 1865 comme usine de pâte à papier. Au fil des décennies, l'entreprise s'était diversifiée : câbles, caoutchouc, électronique. Dans les années 1980, elle développa des téléphones mobiles pour le réseau nordique NMT. En 1987, le Mobira Cityman pesait huit cents grammes — contre près de dix kilos pour les premiers modèles. Mikhaïl Gorbatchev fut photographié avec un Cityman à Helsinki. Le téléphone gagna le surnom de « Gorba ».

En 1991, le premier ministre finlandais Harri Holkeri passa le premier appel GSM au monde sur un téléphone Nokia. L'année suivante, Jorma Ollila devint PDG et concentra toute l'entreprise sur les télécommunications. La stratégie paya au-delà de toute espérance. En 1998, Nokia dépassa Motorola pour devenir le premier fabricant mondial de téléphones mobiles. À son apogée en 2000, Nokia représentait quatre pour cent du PIB finlandais, vingt et un pour cent des exportations, soixante-dix pour cent de la capitalisation boursière d'Helsinki.

Puis vint l'iPhone.

En 2007, Apple présenta un téléphone sans clavier physique, avec un écran tactile et un système d'exploitation conçu pour les applications. Nokia avait eu des smartphones depuis 1996. Elle avait inventé le concept. Mais elle n'avait pas compris que le téléphone devenait un ordinateur de poche. En 2012, Samsung l'avait dépassée. En 2014, elle vendait sa division téléphones à Microsoft.

L'histoire de Nokia est un avertissement : même les pionniers peuvent être dépassés. L'innovation n'est pas un acquis — c'est une course sans fin.

Les réseaux convolutifs : de la France au monde

En 1989, dans les laboratoires de Bell Labs au New Jersey, un chercheur français développait une technique qui transformerait l'intelligence artificielle.

Yann LeCun avait fait son doctorat à Paris, puis un postdoctorat à Toronto avec Geoffrey Hinton. Chez Bell Labs, il créa LeNet — un réseau de neurones « convolutif » capable d'apprendre à reconnaître des caractères manuscrits. L'idée centrale : au lieu de traiter chaque pixel indépendamment, le réseau apprenait des motifs locaux — des courbes, des angles, des lignes — qu'il combinait en caractères.

LeNet apprit à lire les codes postaux manuscrits pour le service postal américain. La version de 1998 atteignait 99 pour cent de précision. Le système de reconnaissance de chèques développé par LeCun fut déployé par NCR et traita plus de dix pour cent des chèques américains au tournant du siècle.

Pendant des années, les réseaux convolutifs restèrent une curiosité — une technique qui fonctionnait sur les chiffres mais pas sur les images complexes. Les ordinateurs n'étaient pas assez puissants. Les données manquaient. En 2012, tout changea. Un réseau convolutif profond nommé AlexNet écrasa la compétition de reconnaissance d'images ImageNet avec un taux d'erreur deux fois plus bas que ses concurrents. L'apprentissage profond était né — et les réseaux convolutifs de LeCun en étaient le cœur.

En 2018, LeCun reçut le prix Turing avec Hinton et Yoshua Bengio — les « parrains de l'IA ». Deux des trois lauréats avaient des racines européennes. L'invention s'était faite en Amérique. Mais les graines avaient germé en France et au Canada.

DeepMind : le retour de l'Europe

En novembre 2010, trois chercheurs fondèrent une startup dans un bureau de Londres. Demis Hassabis, Shane Legg et Mustafa Suleyman avaient une ambition démesurée : « résoudre l'intelligence ».

Hassabis était un enfant prodige britannique — champion d'échecs à treize ans, concepteur de jeux vidéo primé, docteur en neurosciences. Il avait étudié comment le cerveau humain forme des souvenirs et pris des idées. DeepMind combinait apprentissage profond, apprentissage par renforcement et neurosciences computationnelles.

Les premiers succès vinrent des jeux vidéo. En 2013, DeepMind créa un système capable d'apprendre à jouer à quarante-neuf jeux Atari en observant simplement les pixels à l'écran — sans règles, sans programmation explicite. Google remarqua. En 2014, l'entreprise acquit DeepMind pour plus de cinq cents millions de dollars — la plus grande acquisition européenne de son histoire.

En 2016, AlphaGo battit Lee Sedol, champion du monde de Go, quatre parties à une. Le Go était considéré comme le dernier bastion des jeux où l'humain dominait la machine — trop complexe pour la force brute, exigeant intuition et créativité. AlphaGo prouva que les machines pouvaient apprendre l'intuition.

En 2020, AlphaFold résolut un problème vieux de cinquante ans : prédire la structure tridimensionnelle des protéines à partir de leur séquence d'acides aminés. Les biologistes avaient passé des décennies à déterminer ces structures une par une, à coup de cristallographie aux rayons X. AlphaFold les prédit en quelques heures. En 2024, Demis Hassabis reçut le prix Nobel de chimie.

L'Europe avait déclenché le premier hiver de l'IA avec le rapport Lighthill. Cinquante ans plus tard, une startup londonienne était à la pointe de la révolution.

Épilogue — Les leçons de la reconstruction

L'histoire de l'informatique européenne est une histoire de paradoxes.

L'Europe inventa l'ordinateur programmable — et personne ne s'en souvint. Elle créa le premier ordinateur commercial — et perdit le marché. Elle posa les bases de l'intelligence artificielle académique — et saborda sa propre recherche. Elle lança des plans de souveraineté technologique — et vit ses champions absorbés par des conglomérats américains.

Pourtant, quelque chose survécut. Le Web naquit au CERN et fut donné au monde. Linux naquit en Finlande et conquit l'infrastructure. Les réseaux convolutifs naquirent d'un Français et transformèrent l'IA. DeepMind naquit à Londres et repoussa les frontières de l'intelligence artificielle.

La leçon n'est peut-être pas celle qu'on attend. L'Europe n'a jamais rattrapé les États-Unis dans l'industrie informatique. Elle n'a pas créé d'équivalent à IBM, Microsoft, Apple, Google ou Amazon. Ses tentatives de souveraineté technologique — Plan Calcul, Alvey, ESPRIT — ont produit des résultats mitigés au mieux.

Mais l'Europe a fait autre chose. Elle a donné.

Le Web est gratuit parce qu'un laboratoire européen a choisi de ne pas le breveter. Linux est libre parce qu'un étudiant finlandais a adopté une licence ouverte. Ces dons ont transformé le monde plus profondément que n'importe quel produit commercial.

L'Europe a aussi formé des chercheurs qui ont essaimé partout — LeCun chez Facebook, Hassabis chez Google, des milliers d'autres dans les laboratoires et les startups du monde entier. Elle a créé des institutions — INRIA, ETH Zurich, Cambridge, Oxford, Édimbourg — qui continuent de produire des innovations fondamentales.

La reconstruction numérique européenne n'est pas terminée. Elle ne le sera jamais. Les ordinateurs que nous utilisons aujourd'hui portent l'empreinte de Turing et de Zuse, du Manchester Baby et du Ferranti Mark 1, de Prolog et de Linux, du Web et de DeepMind. L'Europe n'a pas gagné la guerre industrielle. Mais elle a façonné le terrain sur lequel cette guerre se livre.

Et parfois, façonner le terrain compte plus que gagner la bataille.