Amériques

Illustrations

1 / 5

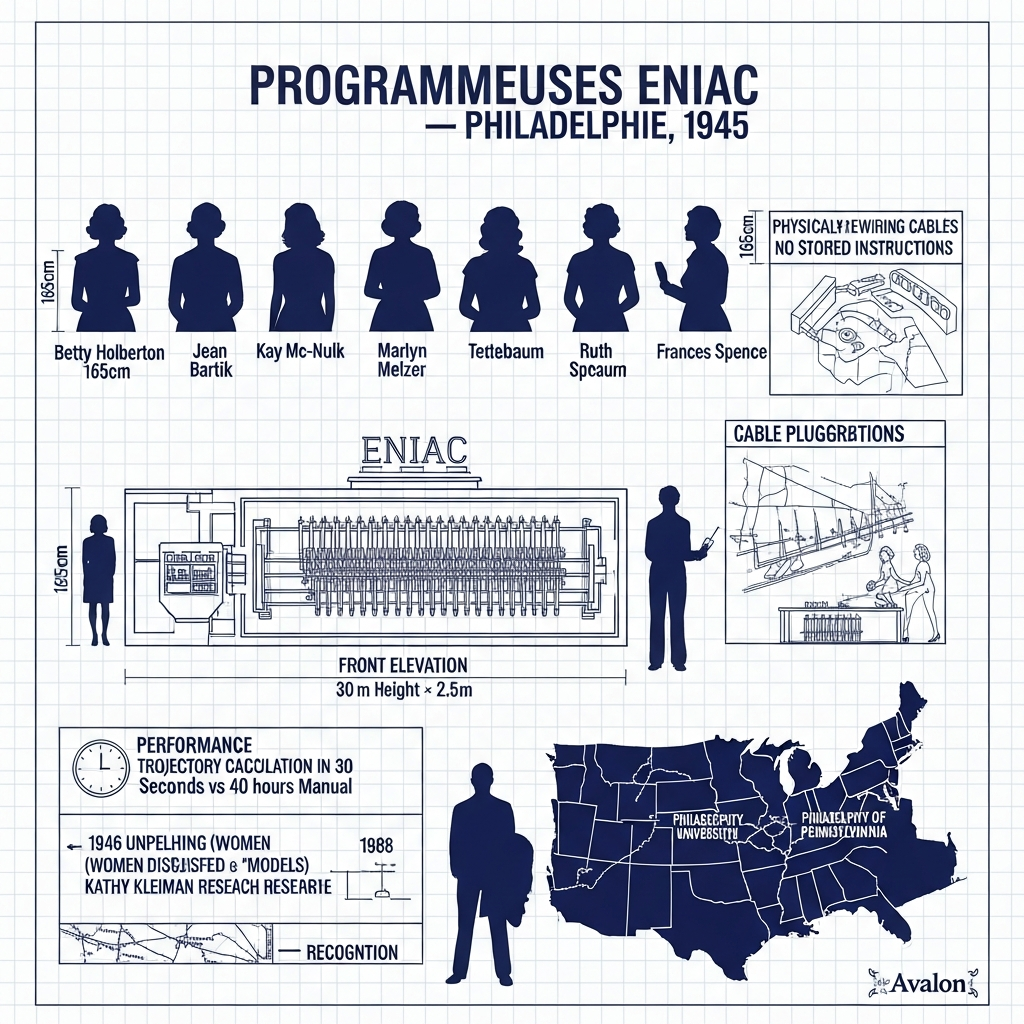

Les six programmeuses de l'ENIAC (1946) : Betty Holberton, Jean Bartik, Kay McNulty, Marlyn Meltzer, Ruth Teitelbaum et Frances Spence — inventeuses de la programmation moderne, longtemps effacées de l'histoire.

Les cycles de l'IA : étés d'espoir, hivers de désillusion

Hier — La naissance et les premières promesses

Les grandes inventions n'ont pas de père. Elles ont des mères — et ces mères, trop souvent, on les efface.

En février 1946, l'armée américaine présenta à la presse sa nouvelle merveille : l'ENIAC, le premier ordinateur électronique américain. La machine occupait une pièce entière, pesait trente tonnes, consommait autant d'électricité qu'un petit quartier. Les journalistes furent éblouis. Les officiers furent nommés, félicités, photographiés. À l'arrière-plan des images, six femmes manipulaient des câbles et des commutateurs. Personne ne les présenta. Personne ne demanda leurs noms.

Ces six femmes — Betty Holberton, Jean Bartik, Kay McNulty, Marlyn Meltzer, Ruth Teitelbaum, Frances Spence — avaient accompli ce que personne n'avait jamais fait : traduire des équations mathématiques complexes en instructions qu'une machine pouvait exécuter. Il n'existait pas de manuel. Pas de précédent. Elles avaient dû comprendre l'architecture de la machine en étudiant les plans des ingénieurs, puis inventer la programmation en marchant. Des décennies plus tard, quand une chercheuse nommée Kathy Kleiman enquêta sur l'identité des femmes dans les photos historiques de l'ENIAC, on lui répondit : « Ce sont des mannequins. »

Ce n'étaient pas des mannequins. C'étaient des mathématiciennes diplômées. Betty Holberton inventa les points d'arrêt pour le débogage. Elle conçut le clavier numérique. Elle persuada les ingénieurs de remplacer l'extérieur noir des ordinateurs par le beige-gris qui devint la couleur universelle des machines. Mais son nom, pendant cinquante ans, fut effacé.

Grace Hopper, docteure en mathématiques de Yale, contre-amiral de la Marine américaine, inventa en 1952 le premier compilateur — ce programme qui traduit les instructions humaines en langage machine. Elle participa à la création du COBOL. Elle popularisa le terme « débogage ». Son génie finit par être reconnu — mais combien d'autres ne connurent jamais cette seconde chance ?

Katherine Johnson, Dorothy Vaughan, Mary Jackson — les calculatrices noires de la NASA, travaillant dans des bureaux étiquetés « Colored Computers » — calculaient à la main les trajectoires des fusées. En 1962, John Glenn refusa de monter dans sa capsule spatiale avant que Katherine Johnson ait vérifié personnellement les calculs de l'ordinateur. Il se méfiait de la machine. Il faisait confiance à la femme.

La forge américaine produisait des merveilles. Elle effaçait aussi les noms de celles qui tenaient le soufflet.

L'été fondateur : Dartmouth et la naissance de l'IA (1956)

Dans les collines du New Hampshire, l'été 1956, une autre fondation se posait — avec moins de discrétion et plus d'arrogance.

Dartmouth College accueillit pendant huit semaines un groupe de mathématiciens, d'ingénieurs et de théoriciens. John McCarthy, Marvin Minsky, Claude Shannon, Nathaniel Rochester avaient obtenu une subvention de la Fondation Rockefeller pour explorer une idée audacieuse. Dans leur proposition, datée du 2 septembre 1955, ils avaient écrit une phrase qui allait définir un champ entier : « Tout aspect de l'apprentissage ou toute autre caractéristique de l'intelligence peut en principe être si précisément décrit qu'une machine peut être faite pour le simuler. »

Ils appelèrent leur projet « intelligence artificielle » — le terme apparaissait pour la première fois. La conférence ne produisit pas de résultat concret spectaculaire. Mais elle fit naître une communauté, une ambition, un vocabulaire. Plus important encore : elle définit un programme de recherche qui allait structurer les décennies suivantes.

Allen Newell et Herbert Simon y présentèrent Logic Theorist, un programme capable de démontrer des théorèmes mathématiques. Arthur Samuel y discuta de son programme de jeu de dames capable d'apprendre de ses erreurs — l'un des premiers exemples d'apprentissage automatique. Les participants repartirent convaincus que l'intelligence artificielle générale était à portée de main. Quelques décennies, peut-être moins.

Cette conviction — cette arrogance, diront certains — allait façonner le premier « été » de l'intelligence artificielle.

L'âge d'or de la recherche académique (1956-1973)

Dans les années qui suivirent Dartmouth, l'intelligence artificielle devint un champ reconnu, financé, institutionnalisé. Des laboratoires s'ouvrirent au MIT, à Stanford, à Carnegie Mellon. Le gouvernement américain, à travers l'agence ARPA — ancêtre de la DARPA —, déversa des millions de dollars dans ces laboratoires. Le directeur de l'Information Processing Techniques Office, J.C.R. Licklider, finançait les projets les plus prometteurs sans trop se soucier de leurs applications militaires immédiates. C'était l'époque de la recherche fondamentale, de l'exploration sans contrainte.

Les résultats furent remarquables.

En 1966, Joseph Weizenbaum, un informaticien germano-américain du MIT, créa ELIZA — le premier programme conçu explicitement pour converser avec des humains. ELIZA simulait un psychothérapeute de l'école rogerienne, reformulant les questions de l'utilisateur sous forme de nouvelles questions. Le programme n'avait aucune compréhension réelle du langage. Il fonctionnait par reconnaissance de motifs et substitution de mots. Pourtant, les utilisateurs furent stupéfaits. Certains demandaient à être seuls avec la machine pour lui confier leurs secrets. La secrétaire de Weizenbaum elle-même exigea de l'intimité pour « parler » à ELIZA.

Weizenbaum fut choqué. Il avait créé une illusion — et les gens y croyaient. Il nomma ce phénomène « l'effet ELIZA » : la tendance humaine à attribuer de l'intelligence et de l'empathie à des machines qui n'en possèdent pas. Plus tard, il devint l'un des critiques les plus virulents de l'intelligence artificielle, publiant en 1976 Computer Power and Human Reason, un avertissement sur les dangers de la pensée machinique.

Entre 1966 et 1972, le Stanford Research Institute développa Shakey — le premier robot mobile capable de raisonner sur ses propres actions. Contrairement aux robots précédents, qui devaient être programmés pour chaque tâche spécifique, Shakey pouvait recevoir un objectif général et déterminer lui-même les étapes pour l'atteindre. Le robot mesurait deux mètres de haut, se déplaçait sur des roues, et portait une antenne, une caméra, des sonars et des « moustaches » pour détecter les obstacles.

En 1969, le New York Times consacra un article à Shakey. En 1970, Life Magazine le qualifia de « première personne électronique ». Le projet, financé par la DARPA, engendra des innovations qui dépassaient largement la robotique : l'algorithme A* pour la recherche de chemins, la transformée de Hough pour l'analyse d'images, le planificateur STRIPS qui reste une référence en intelligence artificielle.

Marvin Minsky reçut le prix Turing en 1969 pour ses travaux pionniers. L'intelligence artificielle semblait sur le point de tout révolutionner. Herbert Simon avait prédit en 1965 que « d'ici vingt ans, les machines seront capables de faire tout travail qu'un homme peut faire ». Minsky avait déclaré en 1967 que « dans une génération, le problème de créer une intelligence artificielle sera substantiellement résolu ».

Ces prédictions allaient se révéler spectaculairement fausses.

Le premier hiver : la chute des illusions (1974-1980)

L'arrogance initiale contenait les germes d'une chute.

En 1969, le Congrès américain adopta l'amendement Mansfield, qui obligeait la DARPA à financer uniquement des recherches « orientées vers une mission » plutôt que de la recherche fondamentale. Le message était clair : l'argent du Pentagone devait produire des résultats militaires tangibles, pas des robots philosophes. Les chercheurs en intelligence artificielle se retrouvèrent contraints de justifier leurs travaux par des applications concrètes — une demande à laquelle beaucoup ne pouvaient pas répondre.

En 1973, le coup de grâce vint de l'autre côté de l'Atlantique. Le professeur Sir James Lighthill, commandité par le Parlement britannique, publia un rapport dévastateur sur l'état de l'intelligence artificielle. Son verdict : « échec total à atteindre ses objectifs grandioses ». Le problème fondamental, selon Lighthill, était l'« explosion combinatoire » — le fait que les algorithmes d'IA fonctionnaient sur des exemples simples mais s'effondraient face à la complexité du monde réel.

Le rapport Lighthill mena au démantèlement quasi-total de la recherche en IA au Royaume-Uni. Aux États-Unis, les effets furent presque aussi dévastateurs. Les financements de la DARPA pour l'intelligence artificielle devinrent difficiles à obtenir. Des laboratoires fermèrent. Des programmes de doctorat furent réduits. Des chercheurs changèrent de domaine.

Le terme « intelligence artificielle » lui-même devint toxique. Les chercheurs qui voulaient obtenir des crédits préféraient parler d'« informatique », d'« intelligence computationnelle », de « systèmes de connaissance » — tout sauf l'expression maudite. C'était le premier « hiver de l'IA » : une période de gel où la recherche survécut à peine, maintenue en vie par quelques laboratoires obstinés et quelques financements résiduels.

Le livre Perceptrons, publié en 1969 par Minsky et Seymour Papert, acheva de tuer une approche prometteuse : les réseaux de neurones artificiels. En démontrant les limitations théoriques des perceptrons — une forme simple de réseau de neurones —, Minsky et Papert découragèrent une génération entière de chercheurs. Les réseaux de neurones ne reviendraient pas avant des décennies.

L'hiver dura six ans.

Aujourd'hui — Les cycles de l'espoir et du désenchantement

Le deuxième été : les systèmes experts (1980-1987)

Au début des années 1980, l'intelligence artificielle connut une renaissance inattendue. La cause : les systèmes experts.

Un système expert est un programme informatique qui encode le savoir d'un spécialiste humain sous forme de règles. « Si le patient a de la fièvre ET des taches rouges, alors envisager la rougeole. » Des centaines, des milliers de règles de ce type, organisées en bases de connaissances, permettaient à la machine de « raisonner » comme un expert.

Le premier système expert significatif, DENDRAL, avait été développé à Stanford dès 1965 pour aider les chimistes à identifier des molécules organiques. Dans les années 1970, MYCIN, également développé à Stanford, fut conçu pour diagnostiquer les maladies infectieuses et recommander des traitements. MYCIN atteignait un taux de succès de soixante-neuf pour cent — meilleur que de nombreux médecins humains. Pourtant, il ne fut jamais utilisé en pratique clinique, notamment pour des raisons juridiques : qui serait responsable en cas d'erreur de diagnostic ?

Le véritable succès commercial vint avec XCON, développé à Carnegie Mellon pour Digital Equipment Corporation. XCON automatisait la configuration des systèmes informatiques VAX — une tâche complexe qui nécessitait jusqu'alors des experts humains. Le système contenait plus de deux mille règles et faisait économiser à DEC plus de quarante millions de dollars par an.

L'industrie s'enflamma. En 1983, la DARPA lança le Strategic Computing Initiative avec des promesses d'applications militaires directes : systèmes experts pour la planification de bataille, compréhension du langage naturel, vision par ordinateur. Le budget atteignait des centaines de millions de dollars. Au Royaume-Uni, le projet Alvey relança la recherche en IA avec trois cent cinquante millions de livres. Au Japon, le projet Fifth Generation Computer Systems visait à créer des ordinateurs révolutionnaires basés sur la programmation logique.

Des entreprises spécialisées dans les « machines Lisp » — des ordinateurs optimisés pour l'intelligence artificielle — prospéraient. Symbolics, Lisp Machines Inc., Texas Instruments vendaient du matériel dédié à des prix astronomiques. L'industrie de l'IA représentait un marché d'un milliard de dollars.

En 1984, lors de la réunion annuelle de l'Association américaine pour l'intelligence artificielle, deux des pionniers — Roger Schank et Marvin Minsky lui-même — lancèrent un avertissement prophétique : l'enthousiasme était hors de contrôle, la déception suivrait inévitablement.

Trois ans plus tard, la prophétie se réalisa.

Les autres Amériques : forges parallèles

Pendant que les États-Unis traversaient leurs cycles d'espoir et de désillusion, d'autres forges s'allumaient ailleurs dans les Amériques — et certaines furent éteintes de force.

Le 8 juin 1958, le Mexique reçut son premier ordinateur. L'UNAM — l'Université nationale autonome du Mexique — avait acquis un IBM-650, machine d'occasion venant de UCLA. L'IBM-709, plus moderne, était trop cher. L'équipe fondatrice — le recteur Nabor Carrillo, le mathématicien Carlos Graef, l'ingénieur Sergio Beltrán López — voulait résoudre des équations pour la mécanique des sols de Mexico City, ville construite sur un ancien lac dont le sous-sol posait des problèmes d'ingénierie uniques. En 1965, le Mexique créa le premier programme de maîtrise en informatique d'Amérique latine.

En Argentine, l'Université de Buenos Aires installa « Clementina », son premier ordinateur scientifique, à l'Institut de calcul. Une équipe dirigée par le professeur Wilfred Durán développa ComIC, le premier langage de programmation argentin. L'équipe était composée de femmes : Clarisa Cortes, Cristina Zoltán, Liana Lew, Noemí García. Dans les années 1960, l'Argentine avait ses propres pionnières de l'informatique — des noms que l'histoire a oubliés.

Au Brésil, le gouvernement adopta en 1972 une politique d'innovation pour développer une industrie informatique nationale. En 1974, une commission fut créée pour réguler les importations d'ordinateurs et protéger les fabricants locaux. Le résultat fut spectaculaire : en 1982, soixante-sept pour cent des ordinateurs installés au Brésil étaient fabriqués dans le pays. Les géants américains — IBM, Hewlett-Packard, Burroughs — avaient été tenus à distance.

Mais l'expérience la plus audacieuse — et la plus tragique — eut lieu au Chili.

En 1970, Salvador Allende fut élu président du Chili sur un programme socialiste. Son gouvernement entreprit de nationaliser les grandes entreprises. Mais comment gérer une économie nationalisée avec les moyens de l'époque ? Fernando Flores, un jeune ingénieur travaillant pour l'agence de développement de l'État, écrivit une lettre au cybernéticien britannique Stafford Beer. Il lui proposait de venir au Chili construire quelque chose qui n'avait jamais existé : un système informatique pour gérer l'économie nationale en temps réel.

Beer accepta. Le projet s'appelait Cybersyn — contraction de « cybernétique » et « synergie ». Le défi était immense : il n'existait qu'une cinquantaine d'ordinateurs dans tout le Chili, et IBM avait réduit ses opérations par peur d'être nationalisé. La solution fut ingénieuse : connecter un seul ordinateur obsolète à plusieurs centaines de télex disséminés dans les usines nationalisées. Chaque jour, les directeurs d'usine envoyaient leurs données de production par télex. Le système central analysait les informations et signalait les anomalies.

Au cœur du projet se trouvait une salle des opérations futuriste : hexagonale, avec sept fauteuils en fibre de verre tournés vers des écrans muraux, des boutons de contrôle intégrés aux accoudoirs. L'objectif n'était pas de centraliser le pouvoir, mais de le décentraliser : permettre aux travailleurs des usines de prendre des décisions éclairées, développer l'autorégulation de l'économie. En 2003, The Guardian qualifia Cybersyn de « sorte d'Internet socialiste, des décennies en avance sur son temps ».

Le 11 septembre 1973, le coup d'État militaire renversa Allende. La salle des opérations de Cybersyn fut détruite. Fernando Flores fut emprisonné pendant trois ans. Stafford Beer retourna en Angleterre. Le projet qui aurait pu montrer qu'une autre informatique était possible — décentralisée, au service des travailleurs, conçue dans le Sud global — fut effacé de l'histoire.

Cuba, soumise à l'embargo américain depuis 1962, connut un sort différent mais tout aussi isolant. La possession d'équipement informatique y fut interdite jusqu'en 2008. L'Internet mobile ne fut autorisé qu'en 2018. Un pays entier, exclu de la révolution numérique par décision géopolitique.

Ces histoires parallèles révèlent une autre face des Amériques numériques. Pendant que la Silicon Valley célébrait ses garages et ses milliardaires, le Mexique formait des informaticiens, l'Argentine créait ses propres langages de programmation, le Brésil protégeait son industrie, le Chili rêvait d'une cybernétique au service du peuple. Certaines de ces forges furent éteintes par la force. D'autres s'éteignirent d'elles-mêmes. Toutes méritent d'être rappelées.

Le deuxième hiver : l'effondrement des systèmes experts (1987-1993)

Le marché des machines Lisp s'effondra presque du jour au lendemain. Apple et Sun Microsystems avaient lancé des stations de travail généralistes aussi performantes que les machines spécialisées, mais à une fraction du prix. Pourquoi acheter un ordinateur Symbolics à cent mille dollars quand une station Sun à dix mille dollars faisait le même travail ?

Les systèmes experts révélèrent leurs limites. Ils étaient coûteux à maintenir — chaque fois que le monde changeait, il fallait mettre à jour manuellement des centaines de règles. Ils étaient rigides — incapables de s'adapter à des situations imprévues. Ils ne fonctionnaient que dans des domaines très étroits. MYCIN diagnostiquait les infections, mais ne savait rien de la cardiologie. XCON configurait des ordinateurs VAX, mais pas d'autres machines.

Le projet Fifth Generation japonais, lancé avec tant de fanfare en 1982, fut déclaré terminé en 1992 sans avoir atteint ses objectifs. Le New York Times titra : « La cinquième génération est devenue la génération perdue du Japon. » L'industrie avait évolué si rapidement que le chemin technologique choisi en 1982 était obsolète dix ans plus tard.

La DARPA, sous la direction de Jack Schwarz, coupa les financements des projets d'IA, qualifiant les systèmes experts de « programmation astucieuse » plutôt que d'intelligence véritable. Le Strategic Computing Initiative fut abandonné.

Le deuxième hiver était plus sévère que le premier. Car il suivait une période d'espoir intense. Les promesses avaient été plus grandes. La déception fut proportionnelle.

Pendant près d'une décennie, le terme « intelligence artificielle » redevint maudit. Les chercheurs survivants se réfugièrent dans des niches : reconnaissance de la parole, vision par ordinateur, robotique. Ils évitaient soigneusement de prononcer les mots interdits.

Les braises sous la cendre (1993-2006)

L'intelligence artificielle ne mourut pas pendant le deuxième hiver. Elle muta.

En 1997, un événement captura l'attention du monde. Deep Blue, un superordinateur conçu par IBM, affronta Garry Kasparov, le champion du monde d'échecs, dans un match en six parties. Kasparov avait battu une version antérieure de Deep Blue en 1996. Cette fois, la machine gagna trois parties et demie contre deux et demie.

Le 11 mai 1997, quand Deep Blue remporta la sixième partie en dix-neuf coups, Kasparov se leva de la table, stupéfait. C'était la première fois qu'un ordinateur battait un champion du monde d'échecs en conditions de tournoi. Kasparov lui-même avait dit que les échecs étaient « le test ultime de l'intelligence machine ». La machine avait passé le test.

Deep Blue n'était pas de l'intelligence artificielle au sens classique. La machine ne « pensait » pas. Elle analysait deux cents millions de positions par seconde, utilisant la force brute plutôt que la compréhension. Mais pour le grand public, la distinction importait peu. Une machine avait battu le meilleur cerveau humain dans le jeu le plus intellectuel qui soit.

IBM retira Deep Blue après sa victoire et l'envoya au Smithsonian Museum. La machine devint une relique — le symbole d'une ère révolue où l'on croyait que la puissance de calcul brute pouvait simuler l'intelligence. IBM se tourna vers d'autres projets : Blue Gene pour le calcul scientifique, puis Watson pour la compréhension du langage naturel.

Pendant ce temps, d'autres formes d'intelligence artificielle émergeaient discrètement. Google, fondée en 1998 par deux doctorants de Stanford, utilisait l'apprentissage automatique pour améliorer ses résultats de recherche. Amazon développait des algorithmes de recommandation. Netflix prédisait les goûts de ses utilisateurs. Ces systèmes ne s'appelaient pas « intelligence artificielle » — le terme restait toxique. Ils s'appelaient « apprentissage automatique », « fouille de données », « analyse prédictive ».

En 2004, Google introduisit un moteur publicitaire capable de cibler les annonces en fonction du contenu des pages et des recherches des utilisateurs. Cette innovation — l'apprentissage automatique appliqué à la publicité — allait financer l'essor de l'entreprise et lui donner les ressources pour investir massivement dans la recherche.

Microsoft, de son côté, développait des outils de reconnaissance vocale et de traduction automatique. En 1998, l'entreprise fonda Microsoft Research China — qui allait former une génération de chercheurs chinois en intelligence artificielle.

Les braises couvaient sous la cendre. La renaissance approchait.

Le troisième été : la révolution de l'apprentissage profond (2006-2010)

Geoffrey Hinton n'avait jamais cessé de croire aux réseaux de neurones.

Né en Angleterre, installé au Canada parce que les financements américains s'étaient taris, Hinton avait travaillé sur les réseaux de neurones depuis les années 1980 — à une époque où presque tout le monde les avait abandonnés après le livre Perceptrons. En 1986, avec David Rumelhart et Ronald Williams, il avait publié un article fondateur sur la rétropropagation — une technique mathématique permettant d'entraîner des réseaux de neurones à plusieurs couches.

Mais les ordinateurs de l'époque n'étaient pas assez puissants pour exploiter cette technique. Les réseaux de neurones restèrent une curiosité académique.

En 2006, Hinton publia un article montrant comment entraîner des réseaux de neurones « profonds » — avec de nombreuses couches — en les pré-entraînant couche par couche. Cette technique, appelée « réseaux de croyance profonde », ouvrit une nouvelle voie. L'année suivante, Fei-Fei Li, une chercheuse née en Chine et arrivée aux États-Unis à seize ans, commença à construire ImageNet — une base de données de douze millions d'images classées en vingt-deux mille catégories.

En 2009, quand Li présenta ImageNet à une conférence de Miami Beach, personne ne s'y intéressa. Son poster fut relégué dans un coin. La communauté scientifique ne croyait pas que plus de données améliorerait les modèles.

Trois ans plus tard, en 2012, Hinton et ses étudiants Alex Krizhevsky et Ilya Sutskever inscrivirent un réseau de neurones profond au concours de reconnaissance d'images organisé autour d'ImageNet. Leur système, AlexNet, atteignit un taux d'erreur deux fois plus bas que le meilleur concurrent. La victoire était si écrasante qu'elle ne laissait aucun doute : l'apprentissage profond fonctionnait.

Ce moment — souvent appelé le « Big Bang » de l'intelligence artificielle moderne — marqua le début du troisième été. Cette fois, les conditions étaient différentes. Les processeurs graphiques (GPU), développés pour les jeux vidéo, offraient une puissance de calcul massive à faible coût. Internet avait généré des quantités astronomiques de données. Les géants de la technologie — Google, Microsoft, Facebook, Amazon — avaient les ressources pour investir massivement dans la recherche.

En 2013, Google acquit une startup britannique nommée DeepMind pour plus de cinq cents millions de dollars. En 2014, Facebook recruta Yann LeCun, un chercheur français qui avait développé les réseaux convolutifs dans les années 1980. Microsoft intensifia ses recherches en reconnaissance vocale et en traduction.

Le troisième été de l'intelligence artificielle avait commencé. Cette fois, peut-être, il ne finirait pas en hiver.

Au-delà — Les leçons des cycles

L'histoire de l'intelligence artificielle aux États-Unis est une histoire de cycles — des étés d'espoir suivis d'hivers de désillusion. Chaque été a produit des innovations remarquables : ELIZA et Shakey dans les années 1960, les systèmes experts dans les années 1980, l'apprentissage profond dans les années 2010. Chaque hiver a tué des carrières, fermé des laboratoires, découragé une génération de chercheurs.

Ces cycles suivent un schéma récurrent. D'abord, une percée technique génère l'enthousiasme. Les médias s'emballent. Les investisseurs affluent. Les promesses deviennent démesurées. Puis l'écart entre les promesses et la réalité devient trop grand. Les systèmes ne font pas ce qu'on attendait d'eux. Le scepticisme s'installe. Les financements s'effondrent.

Mais chaque cycle laisse un héritage. Le premier été a produit les fondements théoriques de l'intelligence artificielle et formé une génération de chercheurs. Le deuxième été a montré que l'IA pouvait avoir des applications commerciales, même limitées. Le troisième été a démontré la puissance de l'apprentissage à partir des données.

Et chaque hiver a enseigné l'humilité. Les machines ne « pensent » pas comme nous. L'intelligence humaine ne se réduit pas à un ensemble de règles. La complexité du monde réel dépasse toujours les modèles simplifiés des laboratoires.

L'histoire américaine de l'intelligence artificielle est aussi une histoire d'oublis. Les six femmes de l'ENIAC, effacées pendant cinquante ans. Les calculatrices noires de la NASA, reléguées dans des bureaux ségrégés. Les pionnières argentines de ComIC — Clarisa Cortes, Cristina Zoltán, Liana Lew, Noemí García — longtemps ignorées par l'histoire officielle. Le projet Cybersyn, détruit par un coup d'État et oublié pendant des décennies. Fernando Flores, emprisonné pour avoir rêvé d'une informatique au service des travailleurs.

Au Canada, de la fin du dix-neuvième siècle jusqu'en 1996, le gouvernement fédéral administra des pensionnats pour enfants autochtones. L'objectif explicite : « tuer l'Indien dans l'enfant ». Au moins cent cinquante mille enfants furent arrachés à leurs familles. Plus de quatre mille décès ont été documentés. Depuis 2021, plus de mille trois cents tombes non marquées ont été découvertes. Ce que les pensionnats détruisirent n'était pas seulement des vies. C'étaient des systèmes de connaissance, des langues, des façons de penser le monde.

Aujourd'hui encore, la fracture persiste. En Amérique latine, soixante-sept pour cent des ménages ont accès à Internet, contre quatre-vingt-onze pour cent dans les pays de l'OCDE. Dans les zones rurales, ce chiffre tombe à trente-sept pour cent. Les peuples autochtones, ceux-là mêmes dont les ancêtres furent envoyés dans les pensionnats, sont parmi les moins connectés. La technologie qui fut créée sur leur sol ne les a pas inclus.

L'Amérique a forgé l'intelligence artificielle. Elle a aussi forgé l'oubli.

Les trois « parrains de l'IA » — Geoffrey Hinton, Yoshua Bengio, Yann LeCun — qui reçurent le prix Turing en 2018, ne sont pas tous américains. Hinton est britannique, installé au Canada. Bengio est né en France de parents marocains. LeCun est français. Fei-Fei Li, la « marraine de l'IA », est née en Chine. L'intelligence artificielle américaine est une histoire d'immigration — et cette histoire est rarement racontée.

En 2024, Hinton reçut le prix Nobel de physique pour ses travaux sur les réseaux de neurones. La même année, il quitta Google pour pouvoir parler librement des dangers de l'intelligence artificielle. Après une vie passée à développer ces technologies, il avertissait désormais l'humanité de leurs risques.

L'histoire de l'intelligence artificielle n'est pas terminée. Un quatrième hiver viendra peut-être. Ou peut-être que cette fois, les conditions sont vraiment différentes. Les données sont infinies. La puissance de calcul continue de croître. Les applications commerciales génèrent des profits qui financent la recherche.

Ce qui est certain, c'est que l'avenir de l'intelligence artificielle dépendra de notre capacité à apprendre des cycles passés. À modérer nos attentes sans abandonner nos ambitions. À reconnaître les contributions de ceux qui ont été oubliés. À nous souvenir que les machines, si intelligentes soient-elles, ne sont que des outils — et que c'est à nous de décider à quoi ils serviront.

La forge américaine a produit des merveilles et des oublis. L'intelligence artificielle que nous construisons aujourd'hui porte l'empreinte de cette double histoire. Elle parle anglais mieux qu'aucune autre langue. Elle reconnaît mieux certains visages que d'autres. Elle reflète les données sur lesquelles elle a été entraînée — et ces données reflètent le monde qui les a créées.

Comprendre cette histoire n'est pas une question de culpabilité. C'est une question de lucidité. Les cycles continueront. Les étés reviendront. Les hivers aussi. Ce qui compte, c'est ce que nous apprendrons — et ce que nous choisirons de ne pas oublier.