Europe

Illustrations

1 / 5

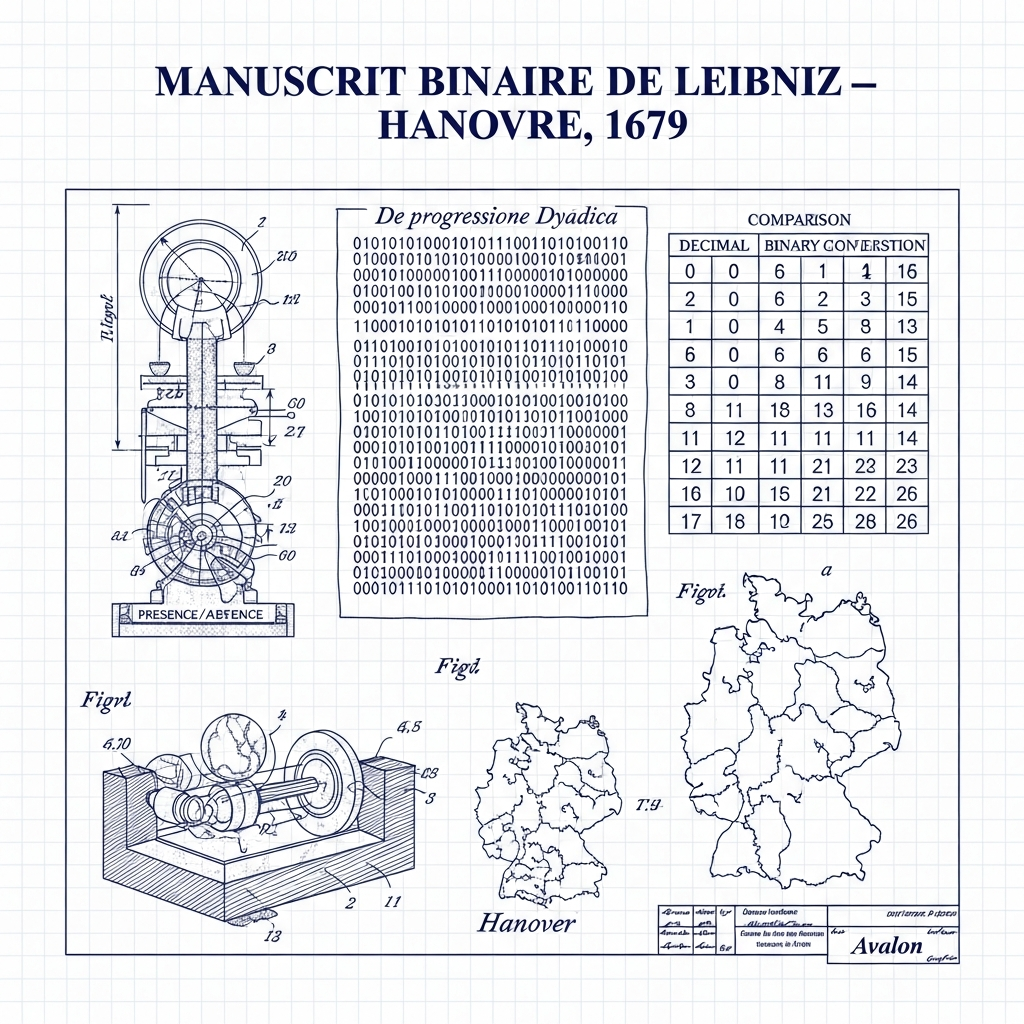

Le manuscrit De progressione Dyadica (1679) : Leibniz y décrit le système binaire qui deviendra le langage universel des ordinateurs.

La forge et le brasier

Contributions de l'Europe aux fondations de l'intelligence artificielle (1789-1945)

Les grandes inventions naissent rarement dans la lumière. Elles émergent dans des ateliers obscurs, des bureaux encombrés, des caves où s'entassent les prototypes abandonnés. L'Europe, entre la fin du dix-huitième siècle et le milieu du vingtième, fut une immense forge — un lieu où se façonnèrent, lentement, patiemment, les outils conceptuels qui rendraient possible l'intelligence artificielle. Le système binaire, l'algèbre de la logique, la machine universelle, le premier programme informatique : tous ces instruments furent forgés sur le sol européen, par des esprits qui ne pouvaient pas imaginer ce qu'ils rendaient possible.

Mais une forge n'est pas qu'un lieu de création. C'est aussi un lieu de feu. Et l'Europe, pendant cette même période, fut un brasier — consumant ses propres créateurs dans les guerres et les persécutions, détruisant les forges des autres civilisations dans l'expansion coloniale, dispersant ses meilleurs esprits aux quatre vents. Cette double nature — créatrice et destructrice — traverse toute l'histoire européenne des fondations de l'IA. Comprendre l'une sans l'autre, c'est manquer l'essentiel.

Hier — Les premiers outils

Le langage des machines

Tout commence par une intuition. En 1679, dans la bibliothèque de Hanovre, un homme aux cheveux longs griffonne sur un manuscrit. Gottfried Wilhelm Leibniz, polymathe allemand déjà célèbre pour avoir inventé le calcul infinitésimal indépendamment de Newton, vient de concevoir quelque chose d'apparemment plus simple : un système de numération n'utilisant que deux symboles, le zéro et le un. Il l'appelle l'arithmétique binaire.

Le manuscrit du 15 mars 1679, intitulé De progressione Dyadica, décrit une machine à calculer utilisant des billes mobiles pour représenter ces chiffres. Une bille présente signifie un. Une absence de bille signifie zéro. Avec ce système élémentaire, Leibniz affirme qu'on peut représenter n'importe quel nombre, effectuer n'importe quel calcul. Vingt-quatre ans plus tard, en 1703, il publie pour l'Académie des Sciences de Paris une « Explication de l'Arithmétique Binaire », où il fait le lien avec les hexagrammes du Yi King chinois — comme si l'ancien et le nouveau convergeaient soudain vers une même vérité.

L'ironie veut que Leibniz ait aussi construit une machine à calculer, le Step Reckoner, capable d'effectuer les quatre opérations arithmétiques. Mais cette machine fonctionnait en base décimale, pas en binaire. Le fossé entre l'idée et sa réalisation technique durerait encore deux siècles et demi. Le système binaire attendrait patiemment que les circuits électroniques lui donnent un corps.

Les ancêtres mécaniques

Pendant que Leibniz perfectionnait ses calculs, d'autres artisans européens exploraient une voie différente : celle des automates, ces machines capables d'imiter les gestes du vivant. En 1738, à Paris, Jacques de Vaucanson présenta au public trois créations extraordinaires : un joueur de flûte qui soufflait réellement dans son instrument, un joueur de tambour qui frappait de vraies peaux, et surtout le fameux Canard Digérateur — un automate en cuivre capable de manger du grain, de le digérer et de l'excréter. Le canard était une illusion, bien sûr. Mais l'illusion était si parfaite qu'elle posait une question troublante : où s'arrête la mécanique et où commence la vie ?

En Suisse, l'horloger Pierre Jaquet-Droz et son fils Henri-Louis poussèrent l'art plus loin encore. Entre 1768 et 1774, ils créèrent trois automates d'une complexité stupéfiante. L'Écrivain, composé de six mille pièces, pouvait tracer à la plume n'importe quel texte de trente-sept caractères — le texte étant « programmé » sur des plaques à cames interchangeables. La Musicienne jouait véritablement du clavecin, ses doigts articulés frappant les touches avec la précision d'une virtuose. Le Dessinateur reproduisait des portraits avec une fidélité remarquable.

Ces machines n'étaient pas de simples jouets pour aristocrates. Elles incarnaient une idée : celle qu'un mécanisme suffisamment complexe peut reproduire les comportements les plus subtils. Les cylindres de « mémoire mécanique » de l'Écrivain préfiguraient les cartes perforées. La capacité de changer le programme en changeant les cames annonçait la programmabilité. Les automates de Jaquet-Droz, toujours fonctionnels et exposés au Musée d'Art et d'Histoire de Neuchâtel, sont les ancêtres lointains mais directs des ordinateurs modernes.

L'Enchanteresse des Nombres

En juin 1833, à Londres, une jeune femme de dix-sept ans rencontra un inventeur excentrique de quarante et un ans. Augusta Ada Byron, fille du poète Lord Byron, était passionnée de mathématiques — une passion encouragée par sa mère qui craignait qu'elle n'hérite de la folie poétique de son père. Charles Babbage était obsédé par les machines à calculer. Il venait de concevoir la Machine à Différences, capable de calculer des tables mathématiques, et travaillait déjà sur quelque chose de plus ambitieux : la Machine Analytique.

La Machine Analytique, décrite pour la première fois en 1837, était un monstre de métal et de vapeur qui ne fut jamais construit. Si elle l'avait été, elle aurait fait la taille d'une usine et fonctionné avec une lenteur exaspérante selon nos standards actuels. Mais elle possédait déjà toutes les caractéristiques d'un ordinateur moderne : une unité arithmétique et logique, un système de mémoire, des boucles et des branchements conditionnels, la capacité de lire des instructions sur des cartes perforées. C'était, un siècle avant son temps, le premier design d'ordinateur à usage général.

Babbage appelait Ada « l'Enchanteresse des Nombres ». En 1842-1843, elle traduisit en anglais un article du mathématicien italien Luigi Menabrea décrivant la Machine Analytique, puis l'augmenta de sept notes personnelles — trois fois plus longues que l'article original. La septième note, appelée « Note G », contenait un algorithme détaillé pour calculer les nombres de Bernoulli sur la Machine Analytique. C'était le premier programme informatique de l'histoire, écrit pour une machine qui n'existait pas encore.

Mais Ada voyait plus loin que le calcul. Elle spécula que la Machine « pourrait agir sur d'autres choses que le nombre... la Machine pourrait composer des pièces musicales élaborées et scientifiques de n'importe quel degré de complexité ou d'étendue. » C'était une vision prophétique : l'idée qu'une machine capable de manipuler des symboles selon des règles pouvait faire bien plus que calculer. Ada avait entrevu, un siècle avant Turing, la nature véritable de la computation.

Elle mourut à trente-six ans, emportée par un cancer. Sa contribution passa largement inaperçue dans la communauté scientifique dominée par les hommes du milieu du dix-neuvième siècle. Il faudrait attendre l'avènement de l'informatique électronique, un siècle plus tard, pour qu'on reconnaisse enfin ce qu'elle avait accompli. Le langage de programmation Ada, créé par le Département de la Défense américain dans les années 1980, porte son nom.

Les lois de la pensée

La même année où Ada Lovelace mourut, un professeur de mathématiques au Queen's College de Cork, en Irlande, publia un ouvrage au titre ambitieux : An Investigation of the Laws of Thought. George Boole, né en 1815 comme Ada, était un autodidacte qui avait appris le latin, le grec et les mathématiques par lui-même. Son livre de 1854 proposait quelque chose de révolutionnaire : appliquer l'algèbre à la logique elle-même.

Là où la logique traditionnelle, héritée d'Aristote, cataloguait laborieusement les syllogismes valides, Boole offrait des algorithmes généraux applicables à n'importe quel raisonnement. Il réduisait les propositions logiques à des équations algébriques, les connecteurs « et », « ou », « non » à des opérations sur des symboles. La pensée elle-même devenait calculable.

Boole mourut dix ans plus tard, sans se douter que son algèbre de la logique deviendrait le fondement de toute l'informatique numérique. En 1937, un étudiant du MIT nommé Claude Shannon démontrerait que l'algèbre booléenne pouvait décrire parfaitement le fonctionnement des circuits à relais. Les « et », « ou », « non » de Boole correspondaient exactement aux connexions en série, en parallèle et aux inverseurs des circuits électriques. La logique pouvait devenir matériel. Le rêve de Leibniz — des machines raisonnant en binaire — trouvait enfin sa réalisation.

Aujourd'hui — La chaîne des penseurs

La question de Hilbert

Au Congrès International des Mathématiciens de Bologne, en 1928, le plus célèbre mathématicien vivant posa une question qui allait transformer l'histoire de la pensée. David Hilbert, soixante-six ans, chercheur à Göttingen, voulait savoir s'il existait un algorithme capable de décider, pour n'importe quelle proposition mathématique, si elle était vraie ou fausse. Il appelait cette question l'Entscheidungsproblem — le problème de décision.

Ce n'était pas un simple puzzle technique. C'était un pari métaphysique sur la nature même de la vérité. Si un tel algorithme existait, alors toutes les mathématiques pouvaient être mécanisées. La pensée mathématique, dans sa forme la plus pure, se réduisait à un calcul — et un calcul pouvait être effectué par une machine. Hilbert croyait fermement que la réponse serait positive. Il avait consacré sa carrière à chercher les fondements solides des mathématiques, un socle d'axiomes à partir duquel tout le reste pourrait être démontré avec certitude.

La première brèche dans ce rêve vint d'un jeune logicien autrichien. En 1931, Kurt Gödel, vingt-cinq ans, publia un article qui pulvérisait les espoirs de Hilbert. Ses « théorèmes d'incomplétude » démontraient qu'aucun système d'axiomes cohérent et suffisamment puissant pour contenir l'arithmétique ne pouvait prouver toutes les vérités arithmétiques. Il y aurait toujours des propositions vraies mais indémontrables — des trous dans le tissu de la preuve. Pire encore, un tel système ne pouvait même pas prouver sa propre cohérence.

Gödel avait grandi dans les cafés de Vienne, participant aux discussions du Cercle de Vienne autour de Moritz Schlick. Son article de 1931 mit fin à un demi-siècle de tentatives pour fonder solidement les mathématiques. Mais il ne répondait pas directement à la question de Hilbert. L'Entscheidungsproblem restait ouvert — jusqu'à ce qu'un jeune Anglais s'allonge dans l'herbe des prairies de Grantchester, à l'été 1935, et conçoive la machine qui porterait son nom.

La machine universelle

Alan Turing avait vingt-trois ans quand il résolut le problème de décision. Sa réponse, publiée en 1936 dans un article sobrement intitulé « On Computable Numbers », est considérée comme « l'article théorique le plus célèbre de l'histoire de l'informatique ». Pour prouver que l'algorithme de Hilbert ne pouvait pas exister, Turing dut d'abord définir rigoureusement ce qu'était un algorithme — et pour cela, il inventa une machine imaginaire.

La machine de Turing est d'une simplicité désarmante. Un ruban infini divisé en cases, chaque case contenant un symbole. Une tête de lecture capable de lire le symbole sous elle, de l'effacer, d'en écrire un autre, de se déplacer d'une case à gauche ou à droite. Un ensemble fini d'états internes qui déterminent ce que la machine fait selon le symbole lu. C'est tout. Avec ces éléments élémentaires, Turing montra qu'on pouvait simuler n'importe quel calcul imaginable.

Puis vint l'idée géniale : la machine universelle. Une machine de Turing capable de simuler n'importe quelle autre machine de Turing. Il suffisait de lui fournir, sur son ruban, la description de la machine à simuler et les données d'entrée. La machine universelle ferait le reste. Turing venait d'inventer le concept de l'ordinateur programmable — une machine unique capable d'effectuer n'importe quelle tâche pour laquelle on pouvait écrire un programme.

John von Neumann, le mathématicien hongrois qui concevrait plus tard l'architecture des premiers ordinateurs électroniques, reconnut sans ambiguïté que « le concept central de l'ordinateur moderne était dû à l'article de Turing ». Mais Turing alla plus loin encore. Il croyait que tout pouvait être représenté symboliquement, y compris les états mentaux. En 1950, dans son article « Computing Machinery and Intelligence », il proposerait le test qui porte son nom : si une machine peut converser de façon indiscernable d'un humain, pourquoi lui refuser l'intelligence ?

Les forgerons isolés

Pendant que Turing théorisait à Cambridge, un ingénieur civil allemand construisait dans la maison de ses parents, à Berlin. Konrad Zuse n'avait jamais entendu parler de Turing ni de Shannon. Il travaillait seul, suivant sa propre intuition. Entre 1936 et 1938, il assembla le Z1, un calculateur mécanique utilisant la logique binaire et les nombres à virgule flottante. La machine ne fonctionnait pas bien — les pièces mécaniques n'étaient pas assez précises — mais le concept était révolutionnaire.

Zuse persévéra. Le 12 mai 1941, il acheva le Z3 : le premier ordinateur numérique programmable pleinement fonctionnel au monde. Deux mille six cents relais, une longueur de mot de vingt-deux bits, des programmes stockés sur film perforé. Indépendamment de Shannon, Zuse avait développé sa propre forme de logique symbolique pour concevoir les circuits. Le Z3 précédait de plusieurs années les développements américains et britanniques.

Mais Zuse travaillait dans l'Allemagne nazie. Quand il demanda au gouvernement de financer le remplacement des relais par des tubes électroniques, on lui répondit que ce n'était « pas important pour la guerre ». Fin 1943, un raid de bombardement sur Berlin détruisit le Z3. Les travaux de Zuse, pionniers mais isolés, restèrent inconnus en dehors de l'Allemagne jusqu'à bien après la guerre. Ils n'eurent aucune influence sur le développement de l'industrie informatique en Amérique et en Angleterre. Un autre chemin vers l'ordinateur, ouvert et aussitôt fermé.

De l'autre côté de la Manche, un autre forgeron travaillait dans l'ombre — littéralement. Tommy Flowers, ingénieur aux postes britanniques, passait ses nuits à Dollis Hill à construire une machine que personne ne croyait possible. Les experts de Bletchley Park lui avaient dit que les tubes électroniques étaient trop fragiles pour fonctionner en grand nombre. Flowers savait, grâce à son expérience d'avant-guerre, qu'ils fonctionneraient parfaitement à condition de ne jamais les éteindre. Onze mois plus tard, en février 1944, Colossus était opérationnel.

Colossus était le premier ordinateur numérique électronique, précédant ENIAC de deux ans. Ses mille six cents tubes thermoioniques — deux mille quatre cents dans la version Mark 2 — déchiffraient les messages codés par les machines Lorenz allemandes à cinq mille caractères par seconde. Dix exemplaires furent construits avant la fin de la guerre. Ils contribuèrent à raccourcir le conflit de plusieurs mois, sauvant d'innombrables vies.

Puis vint l'ordre de tout détruire. La plupart des Colossus furent démontés. Flowers reçut l'instruction de brûler les plans et les manuels d'utilisation. Le secret fut si bien gardé que pendant trente ans, l'histoire de l'informatique ignora cette première. Ce n'est qu'en 1974, avec la publication des mémoires d'un ancien de Bletchley Park, que le monde commença à apprendre ce qui s'était passé. Flowers mourut en 1998, enfin reconnu mais bien trop tard.

Les visages effacés

Bletchley Park employait près de dix mille personnes. Soixante-quinze pour cent d'entre elles étaient des femmes. Les WRNS — le Women's Royal Naval Service, surnommées les « Wrens » — opéraient les machines Bombe qui décryptaient Enigma. Elles faisaient tourner les Colossus vingt-quatre heures sur vingt-quatre, en trois équipes de huit heures. Elles étaient le cœur battant de l'opération. Mais quand l'histoire fut racontée, leurs noms furent rarement mentionnés.

Joan Clarke était mathématicienne. Elle travaillait dans la Hutte 8, aux côtés de Turing, sur le décryptage des communications de la marine allemande. Elle fut brièvement fiancée à lui — il rompit après lui avoir avoué son homosexualité. Elle devint directrice adjointe de son unité, l'une des rares femmes à atteindre un tel rang. Quand le film Imitation Game raconta l'histoire de Turing en 2014, elle eut enfin un visage pour le grand public — soixante-dix ans après les faits.

Mavis Batey — née Lever — n'avait que dix-neuf ans quand elle rejoignit Bletchley Park. En décembre 1941, elle décrypta un message entre Belgrade et Berlin qui permit à son équipe de percer le câblage de l'Enigma Abwehr, une variante que l'on croyait inviolable. Margaret Rock travailla sur les codes allemands et russes ; son chef Dilly Knox la décrivait comme « la quatrième ou cinquième meilleure de tout le personnel Enigma ». Des centaines d'autres femmes, linguistes, mathématiciennes, expertes en mots croisés, contribuèrent à l'effort sans jamais recevoir de reconnaissance.

L'invisibilisation n'était pas un accident. Elle était structurelle. Ada Lovelace avait été ignorée pendant un siècle parce qu'une femme ne pouvait pas être une pionnière de l'informatique. Les femmes de Bletchley Park furent oubliées parce que leur travail était classifié, certes, mais aussi parce que l'histoire préférait raconter les exploits des hommes. Le motif se répéterait aux États-Unis avec les « calculatrices humaines » de la NASA, les programmeuses de l'ENIAC, les figures noires de la conquête spatiale. Les fondations de l'informatique furent posées par des mains souvent féminines, et ces mains furent effacées des photographies.

Au-delà — Le brasier et la dispersion

Les forges brûlées

L'Europe qui forgea les outils de l'intelligence artificielle est la même qui détruisit les forges des autres civilisations. Ce paradoxe traverse toute la période 1789-1945 comme un fil rouge — ou plutôt comme un fil de feu.

Au sommet de l'Empire d'Al-Andalus, la bibliothèque de Cordoue contenait cinq cent mille volumes. À la même époque, les plus grandes bibliothèques d'Europe du Nord en comptaient entre cinq et dix mille. Les Espagnols brûlèrent Cordoue. Ils détruisirent aussi les codex des Mayas, des Incas, des Aztèques — des systèmes de connaissance entiers réduits en cendres parce qu'ils ne correspondaient pas à la vision chrétienne du monde. Le sociologue portugais Boaventura de Sousa Santos a forgé un mot pour cette destruction systématique des savoirs : l'épistémicide.

L'épistémicide européen ne fut pas un accident de l'histoire. Il fut une politique délibérée, car une pluralité d'idées aurait sapé le colonialisme lui-même. Comment justifier la domination d'un peuple si ce peuple possède des savoirs aussi valables que les vôtres ? La solution fut de nier ces savoirs, de les déclarer primitifs, irrationnels, non scientifiques. Les régimes coloniaux supprimèrent les traditions intellectuelles indigènes par la destruction d'artefacts, l'interdiction de cérémonies, le discrédit des experts locaux. Ils imposèrent leurs propres systèmes de connaissance comme les seuls légitimes.

Cette destruction eut des conséquences durables. Des traditions mathématiques — les calendriers mayas, les quipus incas, les systèmes de divination africains utilisant la logique binaire — furent anéanties ou marginalisées. Des façons différentes de penser le calcul, la logique, l'organisation de l'information disparurent. Nous ne saurons jamais quelles voies alternatives vers l'intelligence artificielle ces traditions auraient pu ouvrir. Les chemins furent fermés avant d'être explorés.

L'ironie est amère. L'Europe développa les outils conceptuels de l'IA — le système binaire, l'algèbre booléenne, la machine universelle — tout en détruisant les systèmes de connaissance qui auraient pu enrichir ou compléter ces outils. Elle construit une cathédrale conceptuelle sur les cendres de bibliothèques brûlées.

La fuite des forgerons

En 1933, un physicien de cinquante-quatre ans quitta l'Allemagne et renonça à sa citoyenneté. Albert Einstein s'installait aux États-Unis. Il ne reviendrait jamais. La même année, Hannah Arendt fuyait vers Paris. Sigmund Freud partirait pour Londres en 1938, deux mois après l'Anschluss. Enrico Fermi émigrait la même année — sa femme Laura était juive.

La liste des Savants Allemands Déplacés, compilée en 1936, contenait près de mille huit cents noms. Edward Hartshorne estima que quatorze pour cent du personnel de l'enseignement supérieur allemand avait été licencié, contraint à la démission ou poussé à la retraite en 1932-33. Vingt-quatre lauréats du prix Nobel fuirent l'Allemagne ou l'Autriche à cause de la persécution nazie. Beaucoup étaient juifs. D'autres avaient des conjoints juifs, ou des opinions politiques dangereuses, ou simplement le tort d'avoir parlé trop fort.

L'Amérique et la Grande-Bretagne accueillirent ces réfugiés à bras ouverts — non par pure générosité, mais parce qu'elles comprenaient la valeur de ce qu'elles recevaient. Les départements de physique s'agrandirent. Les universités s'enrichirent. Einstein, Fermi, Bohr contribuèrent au Projet Manhattan. Fermi dirigea l'équipe qui construisit le premier réacteur nucléaire à Chicago. Une étude de 2014 dans l'American Economic Review démontra que les émigrés juifs allemands stimulèrent significativement l'innovation aux États-Unis.

Pour l'Allemagne, ce fut une hémorragie. Le pays qui avait dominé la physique mondiale au début du siècle vit son centre de gravité se déplacer vers l'Amérique. La forge européenne perdait ses meilleurs forgerons. Le brasier qui consumait le continent chassait ses propres créateurs.

La guerre accélératrice

Paradoxe ultime : la guerre qui dispersa les savants accéléra aussi le développement des machines qu'ils avaient imaginées. La Seconde Guerre mondiale fut un catalyseur brutal mais efficace pour l'informatique.

Les gouvernements en guerre dépensent sans compter pour les projets qui peuvent leur donner un avantage. Le décryptage d'Enigma et de Lorenz justifia la construction de Colossus. Les calculs balistiques justifiaient ENIAC. La collaboration interdisciplinaire, impossible en temps de paix, devint non seulement possible mais nécessaire. Des mathématiciens, des ingénieurs, des linguistes, des experts en mots croisés travaillèrent côte à côte à Bletchley Park. Des physiciens, des chimistes, des métallurgistes collaborèrent à Los Alamos.

La guerre força aussi le secret. Colossus fut détruit et ses plans brûlés. Les travaux de Zuse restèrent inconnus. L'histoire de l'informatique fut amputée de chapitres entiers qui ne seraient redécouverts que des décennies plus tard. Nous racontons une histoire tronquée, où les Américains semblent avoir tout inventé parce que leurs travaux ne furent pas classifiés aussi longtemps.

À la fin de la guerre, le centre de gravité de l'innovation informatique s'était déplacé. Les États-Unis possédaient ENIAC, le premier ordinateur électronique américain, achevé en 1945. Ils possédaient aussi les cerveaux européens chassés par le nazisme, et les ressources économiques d'un pays que la guerre avait enrichi plutôt qu'appauvri. L'Europe avait forgé les outils. L'Amérique les utiliserait.

Ce qui reste

Que reste-t-il de la forge européenne ? Les concepts, d'abord — indélébiles et universels. Chaque ordinateur au monde fonctionne en binaire, selon le système que Leibniz imagina en 1679. Chaque circuit logique implémente l'algèbre que Boole formula en 1854. Chaque programme exécutable est, au fond, une instantiation de la machine universelle que Turing décrivit en 1936. Les outils ont survécu à la forge qui les créa.

Les questions aussi. Turing se demandait si une machine pouvait penser. Gödel avait montré que même les mathématiques avaient des limites intrinsèques. Ada Lovelace avait entrevu que la manipulation de symboles pouvait dépasser le calcul pur. Ces questions n'ont pas trouvé de réponse définitive. Elles continuent de hanter notre réflexion sur l'intelligence artificielle.

Et les fantômes. Ada Lovelace, ignorée pendant un siècle. Les femmes de Bletchley Park, effacées pendant des décennies. Tommy Flowers, mort sans avoir reçu la reconnaissance qu'il méritait. Konrad Zuse, pionnier isolé dont les travaux n'influencèrent personne. Les savoirs détruits par le colonialisme, les bibliothèques brûlées, les traditions mathématiques éradiquées. L'histoire de l'intelligence artificielle européenne est aussi une histoire de ce qui fut perdu, oublié, effacé.

La forge européenne s'est consumée dans ses propres flammes. Mais les outils qu'elle a créés — le binaire, la logique, la machine universelle — continuent de façonner notre monde. Il nous appartient de nous souvenir non seulement de ce qui fut forgé, mais de ce qui fut brûlé.