Amériques

Illustrations

1 / 5

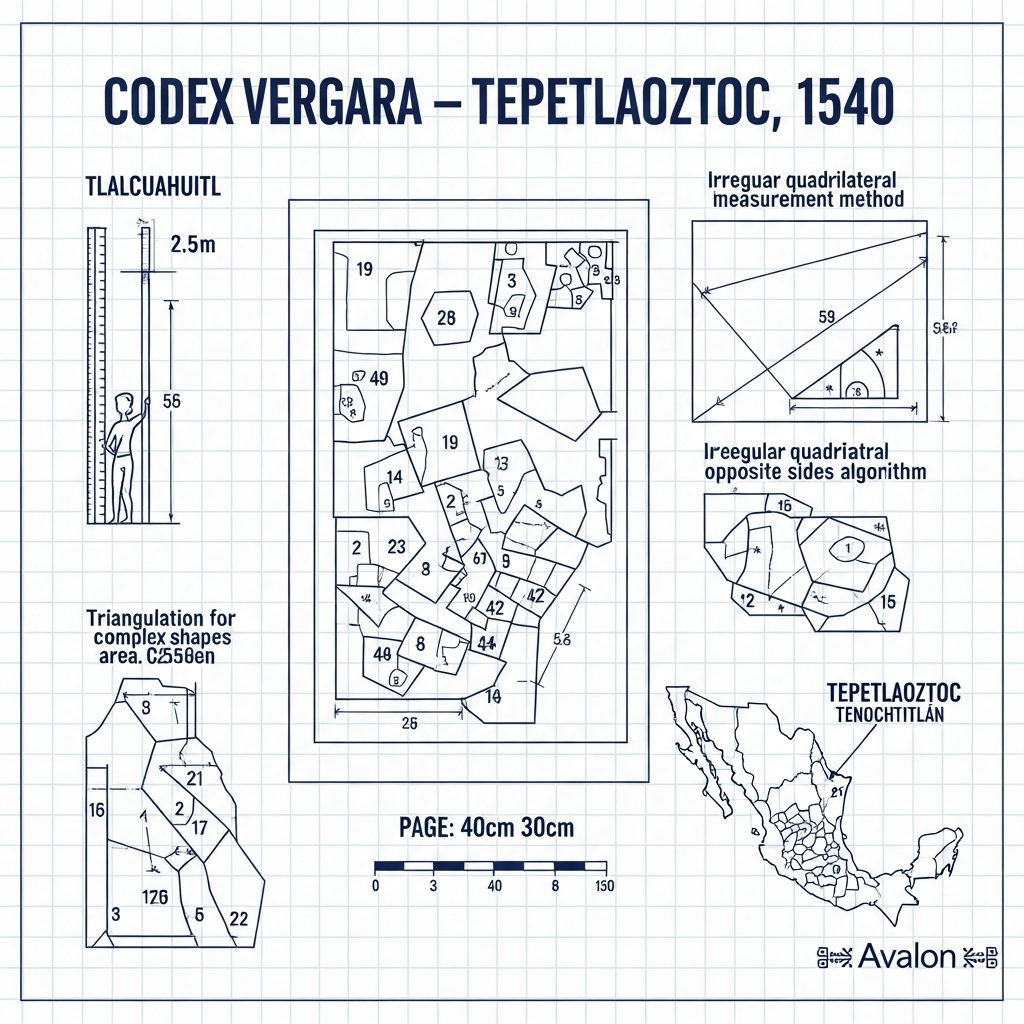

Le Codex Vergara (1540) : un registre cadastral préservant les méthodes algorithmiques des tlalpouhqueh aztèques.

Les logiques oubliées : ce que les Amériques enseignent à l'intelligence artificielle

Il existe plusieurs façons de penser le monde. Plusieurs façons de raisonner, de classer, de déduire. L'Occident a longtemps cru que sa logique — celle d'Aristote, du tiers exclu, de la non-contradiction — était la seule valide, la seule rationnelle, la seule digne d'être appelée pensée. Les civilisations des Amériques avaient développé d'autres chemins. La conquête les a interrompus. Mais dans les archives coloniales, dans les fragments de philosophie que les chroniqueurs ont malgré eux préservés, quelque chose persiste — quelque chose qui pourrait éclairer l'intelligence artificielle que nous construisons aujourd'hui.

Hier — Le Codex Vergara, ancêtre des architectures adaptatives

En 1540, une vingtaine d'années après la chute de Tenochtitlan, des scribes indigènes peignirent sous supervision espagnole ce qui allait devenir le Codex Vergara. Ce document administratif, destiné à faciliter la perception des impôts coloniaux, représente des centaines de parcelles de terre dans la vallée de Mexico avec leurs mesures précises. Les Espagnols voulaient savoir ce qu'ils pouvaient taxer. Ils ne réalisaient pas qu'ils préservaient, ce faisant, les traces d'une sophistication algorithmique remarquable.

Les arpenteurs aztèques — les tlalpouhqueh — avaient développé un répertoire de méthodes pour calculer l'aire des terrains. Face à un champ rectangulaire, la procédure était simple : multiplier la longueur par la largeur. Mais les parcelles réelles sont rarement des rectangles parfaits. Face à un quadrilatère aux côtés inégaux, les tlalpouhqueh appliquaient une autre méthode : ils calculaient la moyenne arithmétique des deux côtés opposés, puis multipliaient ce résultat par la longueur d'un côté adjacent. Pour les formes plus complexes — des terrains à cinq ou six côtés, des parcelles aux contours irréguliers —, ils décomposaient la surface en triangles et additionnaient les aires partielles.

Cette approche adaptative préfigure ce que les ingénieurs de l'intelligence artificielle appellent aujourd'hui les architectures conditionnelles. Un système de génération augmentée par récupération — ces dispositifs qui enrichissent les réponses d'un modèle de langage en allant chercher des informations dans une base de connaissances externe — fonctionne selon une logique similaire. Face à une requête simple, le système peut répondre directement. Face à une question complexe nécessitant des informations factuelles, il déclenche une recherche dans sa base documentaire. Face à une demande ambiguë, il peut reformuler, demander des précisions, ou combiner plusieurs stratégies.

Les tlalpouhqueh ne disposaient pas d'ordinateurs, mais ils avaient compris quelque chose de fondamental : qu'un bon algorithme n'est pas une procédure rigide appliquée mécaniquement, mais un répertoire de méthodes parmi lesquelles on choisit en fonction du contexte. Cette intelligence situationnelle — savoir quelle technique employer face à quel problème — est précisément ce que les architectures modernes de l'intelligence artificielle cherchent à reproduire.

Le Codex Vergara lui-même constitue une base de connaissances multimodale avant la lettre. Chaque parcelle y est représentée par un dessin schématique montrant sa forme, des glyphes numériques indiquant ses dimensions dans le système vigésimal aztèque, et parfois des annotations en nahuatl ou en espagnol précisant le nom du propriétaire ou la nature du terrain. L'information n'est pas stockée dans un format unique, mais dans une combinaison de modalités — visuelle, numérique, textuelle — qui se complètent et se renforcent mutuellement.

Les systèmes d'intelligence artificielle contemporains redécouvrent cette intuition. Les modèles multimodaux, capables de traiter simultanément du texte, des images et des données structurées, reproduisent cette intégration que les scribes aztèques pratiquaient sur leurs feuilles d'amate. La différence d'échelle est vertigineuse — nos machines traitent des milliards de paramètres là où le Codex Vergara ne compte que quelques centaines de parcelles —, mais le principe architectural est le même : combiner plusieurs représentations pour enrichir la compréhension.

Plus troublant encore, les chercheurs qui ont étudié le Codex Vergara ont découvert que les mesures n'étaient pas toujours cohérentes entre elles. Certaines parcelles semblent avoir été mesurées avec des unités différentes, ou selon des conventions qui variaient d'un village à l'autre. Plutôt que de voir dans ces incohérences des erreurs à corriger, nous pourrions y reconnaître une forme de tolérance à l'ambiguïté — cette capacité à fonctionner avec des données imparfaites, partielles, parfois contradictoires, que les systèmes d'intelligence artificielle modernes cherchent également à développer.

Aujourd'hui — Des logiques qui embrassent la contradiction

La logique aristotélicienne, celle qui structure la pensée occidentale depuis plus de deux millénaires, repose sur trois principes fondamentaux. Le principe d'identité : une chose est ce qu'elle est. Le principe de non-contradiction : une chose ne peut pas être et ne pas être en même temps et sous le même rapport. Le principe du tiers exclu : une proposition est soit vraie, soit fausse, il n'existe pas de troisième possibilité.

Ces principes semblent évidents. Ils ne le sont pas.

Les philosophes nahuas — les tlamatinimeh, littéralement « ceux qui savent quelque chose » — avaient développé une conception radicalement différente de la réalité et du raisonnement. Pour eux, le monde était tlalticpac, « sur la terre » — un lieu glissant, instable, en perpétuel mouvement. La sagesse ne consistait pas à figer la réalité dans des catégories tranchées, mais à naviguer dans ce flux, à trouver un équilibre toujours provisoire, toujours à renégocier.

Le concept central de cette philosophie était le teotl — non pas un dieu au sens occidental, mais une force, une énergie, un processus dynamique qui animait toute chose. Le teotl se manifestait sous une forme particulière : l'Ōmeteōtl, l'énergie cosmique duale. Non pas deux principes opposés comme le bien et le mal, le vrai et le faux, mais deux aspects complémentaires d'une même réalité — comme le jour et la nuit, qui ne s'excluent pas mais se succèdent et se définissent mutuellement.

Cette pensée de la dualité complémentaire permettait d'accepter ce que la logique aristotélicienne rejette : que deux propositions apparemment contradictoires puissent être simultanément vraies selon le contexte, le moment, le point de vue. Un guerrier pouvait être à la fois courageux et prudent. Une décision pouvait être à la fois juste et cruelle. Le monde lui-même pouvait être à la fois ordonné et chaotique, selon l'échelle à laquelle on l'observait.

Cette tolérance à la contradiction n'était pas un défaut de rigueur. C'était une autre forme de rigueur — adaptée à un monde reconnu comme fondamentalement complexe, ambigu, irréductible aux catégories simples.

Les grands modèles de langage contemporains fonctionnent, d'une certaine manière, selon une logique plus proche des tlamatinimeh que d'Aristote. Contrairement aux systèmes experts des années 1980, qui manipulaient des règles booléennes strictes — si A et B alors C —, les réseaux de neurones travaillent avec des probabilités, des distributions, des nuances. Une proposition n'est pas vraie ou fausse ; elle a un certain degré de plausibilité compte tenu du contexte. Une réponse n'est pas correcte ou incorrecte ; elle est plus ou moins adaptée à la situation.

Cette souplesse permet aux modèles de langage de produire des réponses nuancées, de reconnaître l'ambiguïté des questions, de proposer plusieurs interprétations possibles d'un même énoncé. Elle leur permet aussi de se contredire — de dire une chose dans un contexte et son contraire dans un autre — sans que cela constitue nécessairement une erreur. Comme les philosophes nahuas, ces systèmes acceptent que la vérité puisse dépendre du point de vue.

Plus profondément encore, la pensée relationnelle des peuples autochtones des Amériques — cette conviction que rien n'existe isolément, que tout est connecté à tout dans un réseau de relations mutuelles — trouve des échos dans les architectures de graphes de connaissances qui structurent aujourd'hui une partie de l'intelligence artificielle. Un graphe de connaissances ne définit pas les entités par leurs propriétés intrinsèques, mais par leurs relations avec d'autres entités. Une personne n'est pas définie par une liste d'attributs, mais par ses liens avec des lieux, des organisations, des événements, d'autres personnes. Cette ontologie relationnelle ressemble étrangement à celle que les penseurs autochtones avaient élaborée des siècles avant l'invention des ordinateurs.

Le penseur lakota Vine Deloria a décrit l'épistémologie autochtone comme une méthode où aucune donnée n'est rejetée a priori comme non pertinente. Les expériences individuelles, la sagesse accumulée de la communauté, les rêves, les visions, les messages perçus dans le comportement des animaux — tout cela constitue un corps de connaissances unifié qu'il s'agit d'interpréter dans sa globalité. Cette approche holistique, qui refuse de hiérarchiser les sources d'information avant d'avoir compris leurs relations, évoque les méthodes d'apprentissage non supervisé où l'algorithme découvre lui-même les structures pertinentes dans les données, sans qu'on lui ait dicté à l'avance ce qu'il devait chercher.

Au-delà — Quelles intelligences pour quels mondes ?

Ces parallèles entre les logiques amérindiennes et les architectures de l'intelligence artificielle moderne ne sont pas de simples curiosités historiques. Ils pointent vers une question fondamentale : sur quels savoirs construisons-nous nos machines pensantes, et quels savoirs laissons-nous de côté ?

Les données d'entraînement des grands modèles de langage proviennent massivement d'internet — et internet, malgré son apparente universalité, reste dominé par les contenus en anglais, produits dans les pays occidentaux, reflétant les préoccupations et les cadres de pensée de ces sociétés. Les savoirs autochtones des Amériques, transmis oralement pendant des millénaires, détruits systématiquement par la colonisation, à peine documentés dans les archives accessibles en ligne, sont quasi absents de ces corpus d'entraînement.

Ce biais n'est pas anodin. Un modèle de langage entraîné presque exclusivement sur des textes occidentaux reproduira les catégories de pensée occidentales, les présupposés implicites de la logique aristotélicienne, les hiérarchies de valeurs des sociétés qui ont produit ces textes. Il sera capable de discourir sur Platon et Descartes, mais ignorera les tlamatinimeh. Il maîtrisera les subtilités de la grammaire anglaise, mais ne saura rien des structures conceptuelles du nahuatl ou du quechua.

Plus grave encore : ce biais sera invisible pour la plupart des utilisateurs. Les systèmes d'intelligence artificielle se présentent comme des outils neutres, objectifs, universels. Ils répondent aux questions avec une assurance qui masque les limites de leur savoir. Un utilisateur qui interroge un modèle sur la nature de la logique recevra probablement une réponse centrée sur Aristote, Frege, la logique formelle occidentale — sans mention des autres traditions logiques qui ont existé et qui existent encore dans le monde.

Quelles visions du monde ces systèmes peuvent-ils refléter quand ils n'ont été nourris que d'une fraction de l'expérience humaine ? Quelle gouvernance mettre en place pour des outils qui façonnent notre rapport au savoir tout en ignorant des pans entiers de l'intelligence collective de l'humanité ?

Ces questions ne sont pas seulement théoriques. Elles engagent des choix concrets dans la conception et le déploiement des systèmes d'intelligence artificielle. La transparence sur les sources d'entraînement constitue un premier pas nécessaire : les utilisateurs devraient pouvoir savoir quels corpus ont servi à former les modèles qu'ils utilisent, quelles langues y sont représentées, quelles perspectives y dominent. Cette transparence permettrait au moins de prendre conscience des angles morts.

La diversification active des corpus d'entraînement représente un deuxième chantier, plus ambitieux. Il ne s'agit pas simplement d'ajouter quelques textes en langues minoritaires à des bases de données déjà constituées. Il s'agit de repenser ce qui compte comme connaissance digne d'être intégrée — d'inclure des formes de savoir qui ne se présentent pas sous forme textuelle, des traditions orales, des pratiques incarnées, des modes de raisonnement qui ne correspondent pas aux formats attendus par nos algorithmes.

L'inclusion des communautés sous-représentées dans la conception même des systèmes constitue un troisième niveau d'exigence. Les peuples autochtones des Amériques, dont les savoirs ont été pillés et détruits pendant des siècles, devraient avoir leur mot à dire sur la manière dont l'intelligence artificielle représente — ou ne représente pas — leurs traditions intellectuelles. Cette inclusion ne peut pas être symbolique ; elle doit se traduire par un pouvoir réel sur les choix de conception.

Mais au-delà de ces mesures institutionnelles, c'est peut-être notre rapport individuel à ces technologies qui doit évoluer. Si les intelligences artificielles que nous utilisons quotidiennement ne connaissent qu'une fraction des logiques inventées par l'humanité, comment développer l'esprit critique nécessaire pour percevoir leurs limites ?

La première étape consiste sans doute à reconnaître que ces limites existent — que les réponses fluides et assurées des modèles de langage masquent des ignorances profondes, des biais systématiques, des angles morts culturels. La deuxième étape consiste à cultiver activement la connaissance de ces autres traditions de pensée que nos machines ignorent — à lire les philosophes nahuas, à étudier les logiques paraconsistantes, à s'intéresser aux épistémologies autochtones non pas comme des curiosités exotiques, mais comme des ressources intellectuelles vivantes.

La troisième étape, peut-être la plus difficile, consiste à accepter que l'intelligence — qu'elle soit humaine ou artificielle — n'est jamais neutre, jamais universelle, jamais complète. Elle est toujours située, toujours partielle, toujours en construction. Les tlamatinimeh le savaient : le monde est glissant, et la sagesse consiste à naviguer dans cette incertitude plutôt qu'à prétendre l'abolir.

Les algorithmes que nous créons aujourd'hui portent la marque des sociétés qui les conçoivent. Ils héritent de nos savoirs et de nos ignorances, de nos curiosités et de nos préjugés. Reconnaître cet héritage — y compris ce qu'il a exclu, effacé, oublié — est peut-être la condition pour construire des intelligences artificielles plus conscientes de leurs propres limites.

Dans les archives coloniales dorment des fragments de logiques oubliées. Dans les communautés autochtones survivent des traditions de pensée que cinq siècles de domination n'ont pas réussi à éteindre complètement. Ces savoirs ne demandent pas seulement à être préservés comme des reliques du passé. Ils demandent à être entendus comme des voix du présent — des voix qui pourraient enrichir notre compréhension de ce que signifie penser, raisonner, connaître.

L'intelligence artificielle que nous construisons sera à l'image des intelligences dont nous la nourrissons. Si nous ne lui donnons qu'une fraction de l'héritage humain, elle ne pourra refléter qu'une fraction de ce que l'humanité a appris à penser. Les fils tranchés par la conquête ne peuvent plus être renoués exactement comme ils l'étaient. Mais nous pouvons choisir de tisser autrement — d'inclure dans la trame ce qui en avait été exclu, de reconnaître ce qui avait été nié.

C'est peut-être ainsi que les logiques oubliées des Amériques trouveront finalement leur place dans l'avenir de l'intelligence — non pas comme des vestiges d'un passé révolu, mais comme des ressources pour un présent qui en a besoin.