Europe

Illustrations

1 / 5

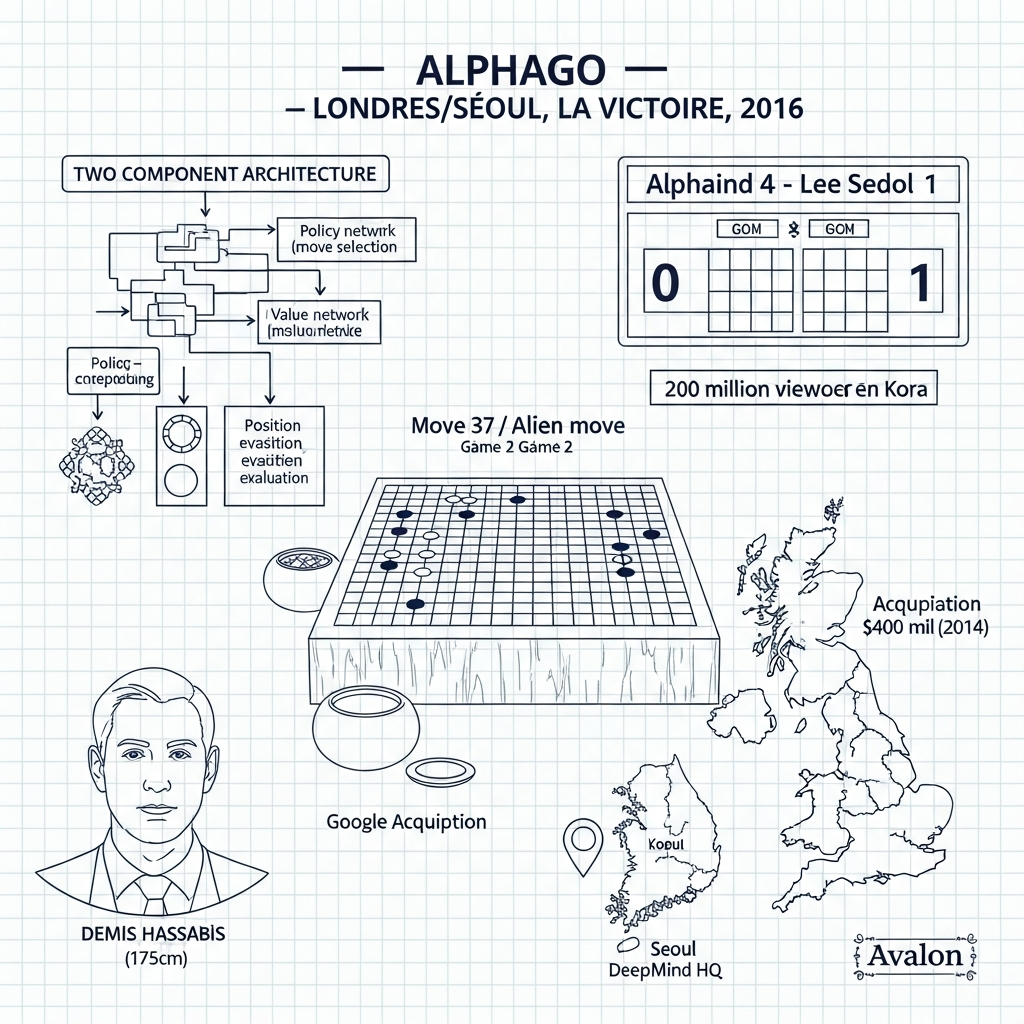

DeepMind et AlphaGo (2016) : la victoire historique contre Lee Sedol qui marqua le grand retour de l'IA.

Europe — La règle et l'exception

Comment l'Europe inventa la régulation de l'IA et fit surgir Mistral de l'improbable

Hier — Les héritiers de Bletchley Park

Il existe une forme particulière de génie européen : celui qui naît dans l'adversité, s'épanouit dans la discrétion, et ne reçoit sa reconnaissance qu'après coup.

En 2010, trois hommes fondèrent une entreprise à Londres. Demis Hassabis, Shane Legg, Mustafa Suleyman. Leur ambition : créer une intelligence artificielle générale — une machine capable d'apprendre n'importe quelle tâche intellectuelle qu'un humain peut accomplir. Ils l'appelèrent DeepMind.

Demis Hassabis était un prodige. Champion d'échecs à treize ans, concepteur de jeux vidéo à dix-sept, neuroscientifique à vingt-neuf. Il avait grandi à Londres, étudié à Cambridge et à University College London. Il incarnait une tradition européenne de pensée transdisciplinaire — un pont entre les neurosciences et l'informatique, entre la théorie et l'application.

En 2014, Google acheta DeepMind pour quatre cents millions de livres sterling. L'Europe venait de produire l'une des startups d'IA les plus prometteuses du monde — et de la vendre à un géant américain.

Mais DeepMind, même sous pavillon Google, resta à Londres. Et elle transforma le monde.

En mars 2016, AlphaGo battit Lee Sedol, l'un des meilleurs joueurs de go de l'histoire, quatre parties à une. Le go — un jeu de stratégie chinois vieux de plus de deux mille cinq cents ans — avait été considéré comme un « graal » de l'intelligence artificielle. Le nombre de positions possibles sur un plateau de go dépasse le nombre d'atomes dans l'univers observable. Les techniques traditionnelles de programmation avaient échoué pendant des décennies. AlphaGo y parvint en combinant apprentissage profond et recherche arborescente — une synthèse de force brute et d'intuition apprise.

La victoire fit le tour du monde. En Corée du Sud, où le go est un sport national, deux cents millions de personnes regardèrent les parties en direct. L'IA venait de franchir un seuil symbolique. Ce que l'humain considérait comme l'expression suprême de son intelligence stratégique pouvait désormais être surpassé par une machine.

Puis vint AlphaFold.

Le repliement des protéines — la façon dont une chaîne d'acides aminés se plie pour former une structure tridimensionnelle — était l'un des problèmes les plus difficiles de la biologie. Depuis cinquante ans, des chercheurs du monde entier tentaient de le résoudre. La structure détermine la fonction ; comprendre comment les protéines se replient permettrait de comprendre les maladies, de concevoir des médicaments, de transformer la médecine.

En 2020, AlphaFold2 résolut le problème. Le système pouvait prédire la structure d'une protéine avec une précision comparable aux méthodes expérimentales — mais en quelques minutes plutôt qu'en mois ou années. DeepMind publia les prédictions pour deux cents millions de protéines connues, les mettant gratuitement à disposition de tous les chercheurs du monde.

Plus de deux millions de scientifiques dans cent quatre-vingt-dix pays utilisent aujourd'hui AlphaFold. La revue Science désigna AlphaFold2 comme « percée de l'année » en 2021.

En octobre 2024, Demis Hassabis et John Jumper reçurent le prix Nobel de chimie — partageant la distinction avec David Baker pour ses travaux sur la conception computationnelle des protéines. L'intelligence artificielle venait de remporter un Nobel. L'Europe, via DeepMind, avait contribué à cette révolution.

Aujourd'hui — La règle

Pendant que DeepMind transformait la biologie, l'Europe faisait autre chose que personne d'autre n'osait faire : elle réglementait.

Le 12 juillet 2024, le Règlement sur l'intelligence artificielle — l'AI Act — fut publié au Journal officiel de l'Union européenne. C'était la première législation complète au monde encadrant l'IA. Elle entra en vigueur le 1er août 2024.

L'Europe avait choisi de réguler ce qu'elle ne dominait pas.

L'approche reposait sur le risque. Plus un système d'IA pouvait causer de dommages, plus les règles étaient strictes. Quatre catégories furent définies.

Les systèmes à « risque inacceptable » furent interdits. La reconnaissance faciale de masse. La notation sociale. La manipulation comportementale exploitant les vulnérabilités. La police prédictive fondée uniquement sur le profilage. L'Europe traçait des lignes rouges que d'autres n'osaient pas tracer.

Les systèmes « à haut risque » — ceux utilisés dans l'emploi, la justice, l'accès aux services essentiels — furent soumis à des obligations strictes. Gestion des risques. Supervision humaine. Transparence. Audits réguliers. Documentation technique. Les entreprises qui déployaient ces systèmes devaient prouver qu'ils étaient sûrs et équitables.

Les systèmes à « risque limité » — comme les agents conversationnels — furent soumis à des obligations de transparence. L'utilisateur devait savoir qu'il interagissait avec une machine.

Les systèmes à « risque minimal » — la grande majorité des applications IA — restèrent non réglementés.

Les sanctions étaient sévères : jusqu'à trente-cinq millions d'euros ou sept pour cent du chiffre d'affaires mondial, selon le montant le plus élevé. L'Europe montrait qu'elle prenait la régulation au sérieux.

Les modèles d'IA à usage général — comme GPT-4 ou Claude — furent soumis à des exigences de transparence : respect du droit d'auteur, publication de résumés détaillés des contenus d'entraînement. Les modèles les plus puissants, susceptibles de poser des risques systémiques, devaient en plus réaliser des évaluations, atténuer les risques identifiés, signaler les incidents.

L'AI Act créait un précédent mondial. Comme le Règlement général sur la protection des données (RGPD) avait influencé les lois sur la vie privée dans le monde entier, l'AI Act pourrait devenir un modèle pour la régulation de l'IA à l'échelle planétaire. L'Europe exportait ses normes — faute de pouvoir exporter ses technologies.

Les critiques ne manquèrent pas. Certains affirmaient que l'Europe réglementait une industrie où elle n'avait pas de champions. Que les contraintes décourageraient l'innovation. Que les entreprises européennes seraient désavantagées face à des concurrents américains ou chinois moins encadrés. Que l'Europe devenait un musée de la technologie — un lieu où l'on préservait les valeurs du passé plutôt que de construire l'avenir.

D'autres répondaient que la régulation n'était pas l'ennemi de l'innovation — qu'elle pouvait au contraire créer un cadre de confiance permettant le déploiement massif de l'IA. Que les entreprises qui respectaient les normes européennes gagneraient un avantage concurrentiel sur les marchés soucieux d'éthique. Que l'Europe choisissait de défendre une vision de l'IA compatible avec les droits fondamentaux.

Le débat restait ouvert. Mais l'Europe avait fait un choix — et ce choix façonnerait la décennie suivante.

L'exception

Puis l'improbable survint.

En avril 2023, trois Français fondèrent une entreprise à Paris. Arthur Mensch, trente-deux ans, ancien de Google DeepMind. Guillaume Lample et Timothée Lacroix, trentenaires, anciens de Meta. Tous trois s'étaient rencontrés à l'École polytechnique. Ils créèrent Mistral AI.

Deux mois plus tard, en juin 2023, Mistral leva cent cinq millions d'euros — le plus grand financement initial jamais réalisé pour une startup européenne d'IA. En décembre, une deuxième levée de trois cent quatre-vingt-cinq millions suivit, portant la valorisation à plus de deux milliards de dollars. L'Europe avait son champion.

Mistral ne cherchait pas à copier OpenAI. Elle proposait une approche différente. Ses modèles étaient ouverts — le code source et les poids du réseau étaient publiés, permettant à quiconque de les utiliser, de les modifier, de les adapter. Cette stratégie, inspirée du logiciel libre, visait à créer un écosystème où l'innovation serait collective plutôt que concentrée.

Les modèles Mistral rivalisaient avec ceux des géants américains sur de nombreux tests de performance — tout en étant plus légers, plus rapides, moins coûteux à exécuter. L'efficacité européenne face à la puissance brute américaine.

En juin 2024, Mistral leva six cents millions d'euros, portant sa valorisation à près de six milliards de dollars. Elle était devenue la quatrième entreprise d'IA au monde par la valorisation — et la première en dehors de la baie de San Francisco.

En septembre 2025, ASML, le géant néerlandais des équipements de fabrication de semi-conducteurs, mena une levée de fonds d'un milliard sept cents millions d'euros, valorisant Mistral à près de quatorze milliards de dollars. Les trois fondateurs devinrent les premiers milliardaires français de l'IA.

Mistral prouvait que l'Europe pouvait produire des champions — pas seulement les vendre aux Américains comme elle l'avait fait avec DeepMind. L'exception existait.

Mais l'exception restait précaire.

Aleph Alpha, la startup allemande qui devait être le Mistral de l'Allemagne, abandonna ses ambitions de grand modèle de langage en 2024. L'Europe restait fragmentée — chaque pays voulant son champion national plutôt que de construire des écosystèmes à l'échelle continentale.

Le Royaume-Uni, sorti de l'Union européenne, conservait DeepMind mais n'avait pas fait émerger de successeur comparable. La France avait Mistral. L'Allemagne avait des centres de recherche mais peu de startups de premier plan. Les petits pays européens n'avaient souvent rien.

L'investissement européen dans l'IA restait une fraction de celui des États-Unis ou de la Chine. Les talents formés en Europe partaient souvent pour la Silicon Valley, attirés par des salaires plus élevés et des écosystèmes plus dynamiques. La fuite des cerveaux continuait.

L'Europe produisait des chercheurs de classe mondiale — Yann LeCun, l'un des parrains de l'IA, était français avant de devenir américain. Elle formait des ingénieurs excellents. Mais elle peinait à transformer cette excellence en entreprises dominantes.

Au-delà — Le choix européen

L'Europe de l'IA est le lieu d'une tension fondamentale : entre la règle et l'exception, entre la régulation et l'innovation, entre les valeurs et la puissance.

Elle nous enseigne d'abord que la régulation peut précéder la domination. L'Europe a choisi de définir les règles du jeu de l'IA mondiale — même si elle n'en était pas le joueur dominant. L'AI Act est un pari : celui que les normes européennes deviendront des normes mondiales, que les entreprises du monde entier devront s'y conformer pour accéder au marché européen de cinq cents millions de consommateurs. C'est l'« effet Bruxelles » — la capacité de l'Europe à projeter ses standards au-delà de ses frontières.

Elle nous enseigne ensuite que l'excellence scientifique ne garantit pas la domination économique. L'Europe a inventé le World Wide Web (Tim Berners-Lee au CERN), Linux (Linus Torvalds en Finlande), les réseaux de neurones convolutionnels (Yann LeCun en France). Elle a produit DeepMind, qui a remporté un prix Nobel. Mais les géants de l'IA mondiale — OpenAI, Google, Anthropic, Meta — sont américains. Le passage de la recherche à l'industrie reste le maillon faible européen.

Elle nous enseigne enfin que les exceptions peuvent devenir des modèles. Mistral a prouvé qu'une startup européenne pouvait rivaliser avec les géants américains en moins de deux ans. DeepMind a prouvé que l'Europe pouvait produire des percées scientifiques majeures en IA. Ces exceptions montrent que l'Europe a le potentiel — le défi est de le systématiser.

Le choix européen est un choix de civilisation.

L'Europe a décidé que l'IA devait respecter les droits fondamentaux. Que la reconnaissance faciale de masse était incompatible avec une société libre. Que la manipulation comportementale était inacceptable. Que les humains devaient garder le contrôle sur les machines. Que la transparence n'était pas négociable.

Ces choix ont un coût. Ils peuvent ralentir l'innovation. Ils peuvent désavantager les entreprises européennes face à des concurrents moins scrupuleux. Ils peuvent faire de l'Europe un spectateur plutôt qu'un acteur de la révolution IA.

Mais ils ont aussi une valeur. Ils définissent ce que l'Europe refuse de sacrifier — même pour la puissance technologique. Ils offrent un modèle alternatif à celui de la Silicon Valley (l'innovation à tout prix) et à celui de Pékin (l'innovation sous contrôle étatique). Ils proposent une troisième voie : l'innovation encadrée par les droits.

Cette voie est-elle viable ? Mistral et DeepMind suggèrent que oui — que l'Europe peut innover tout en respectant ses valeurs. L'AI Act suggère que oui — que la régulation peut coexister avec la création. Mais l'histoire n'est pas écrite.

L'Europe a forgé la règle. Elle a fait surgir l'exception. La question qui reste ouverte est de savoir si l'exception deviendra la norme — ou si elle restera une lueur dans un paysage dominé par d'autres.